about me

个人简介

introduction

Graduated from ZheJiang University in 2020 as a Full-time undergraduate, majored in EE/CS;

Software engineer with 5 years+ working experience including

- High-Performance and Virtualized Network Development in Cloud Computing; Full-stack development in k8s cni

- Industrial embedded software development on microprocessors Like Arm-M like soc

- Kernel And Qemu enthusiast

contact me

Email: 3160104094@zju.edu.cn

关于本项目

-

定位为一个技术笔记,记录过程是主要目的。 包含了我目前的工作方向: k8s, cni, 虚拟化, linux kernel以及我想学习的领域,比如 llm, web3, 量化,etc…

-

这个项目的内容会很杂,我会尽量把它做的全。

-

欢迎讨论和提出修改意见,link

ysyx

记录一下我参加 https://ysyx.oscc.cc/ 项目的学习过程

预学习

F.1

基础情况介绍

先要做一个通识问卷, 讲诉一生一芯的一些基本情况。

提问的技巧

嗯,这个很好。可能在学校里问老师多蠢的问题都可以,但是去社会上这个干很可能会导致自己人缘不好。 写了一些感想:

提问是双向的,对于已经工作的人来说,更是如此。对于一个问题,如果没有仔细思考过/尝试过就把它抛给别人,是很不负责的,往远了说,这种人的人际关系也是不咋地的。 对于一个问题,首先应该去自己思考,方式包括 STFW, RTFM, RTFSC,当然,现在还包括问AI。但不建议一上来就问AI,因为万一出现了幻觉现象,可能会导致后面的努力全白费,对于一个问题,应该有一些最基础的认知,再进行后续的工作,会使得对方(无论是ai或者资深工程师)产生错误输出的概率低很多。

F.2

logisim 安装与使用

在我的mac电脑上通过 wget https://github.com/logisim-evolution/logisim-evolution/releases/download/v4.1.0/logisim-evolution-4.1.0-aarch64.dmg 然后就能够顺利运行了。

三个实验

- 阅读guide

然后通过 RTFM 实现了教程中的两个电路。

-

io library

- button: 开关,和输出好像差不多

- DIP switch: 文档好像没有,应该是拨码器

- joystick: 两个若干bit的数据,(x,y)代表这个杆子的位置

- led: 灯

- led rgb: rgb 灯

- keyboard: 键盘

- 7-segment Display: 数码管

- hex digit display: 16进制数码管

- led matrix: led 矩阵

- tty: 串口

-

实现有趣的电路

说实话,没有什么想法,先留空吧。

F.3 数字电路基础

前言:大学里学过数电,所以对我来说可能更多的是复习,笔记不一定很全。但是学的时间很久了,大概八年前,所以实验作业也不一定对,仅供参考。

后面发现可以记录工作,于是把作业都放这儿

基础门电路

实验

- 分析门电路

| A | B | Y |

|---|---|---|

| 0 | 0 | 1 |

| 0 | 1 | 0 |

| 1 | 0 | 0 |

| 1 | 1 | 0 |

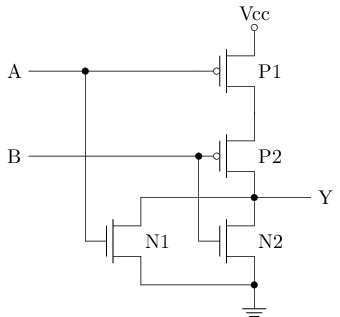

我记得有个什么方法可以算这种的,但现在忘了,好在这里一眼就看出来了。应该叫它或非门。

Y = ~(A|B) or Y = (~A) & (~B)

-

设计或门 只需要在上面的实验输出后面再加上一个非门,就可以实现或门。

-

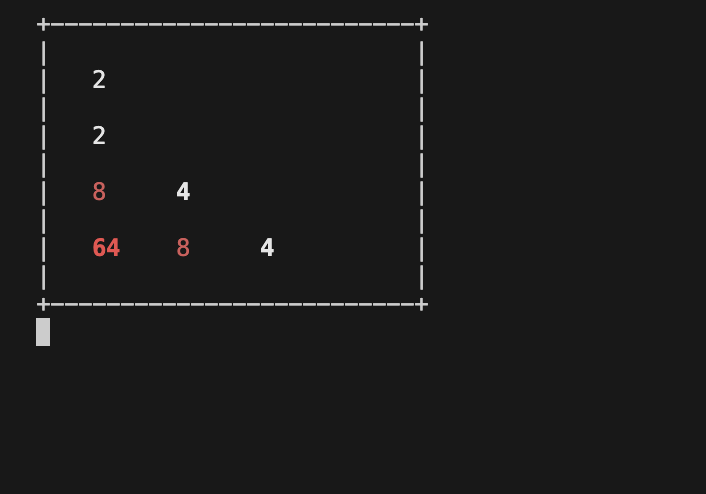

分析三输入与非门晶体管数量

方案一: 通过一个与门与一个与非门实现。按照前面的课程,一个与门需要6个晶体管,一个与非门需要4个晶体管,那么一共需要10个晶体管。

方案二: 通过晶体管搭建。需要6个晶体管。

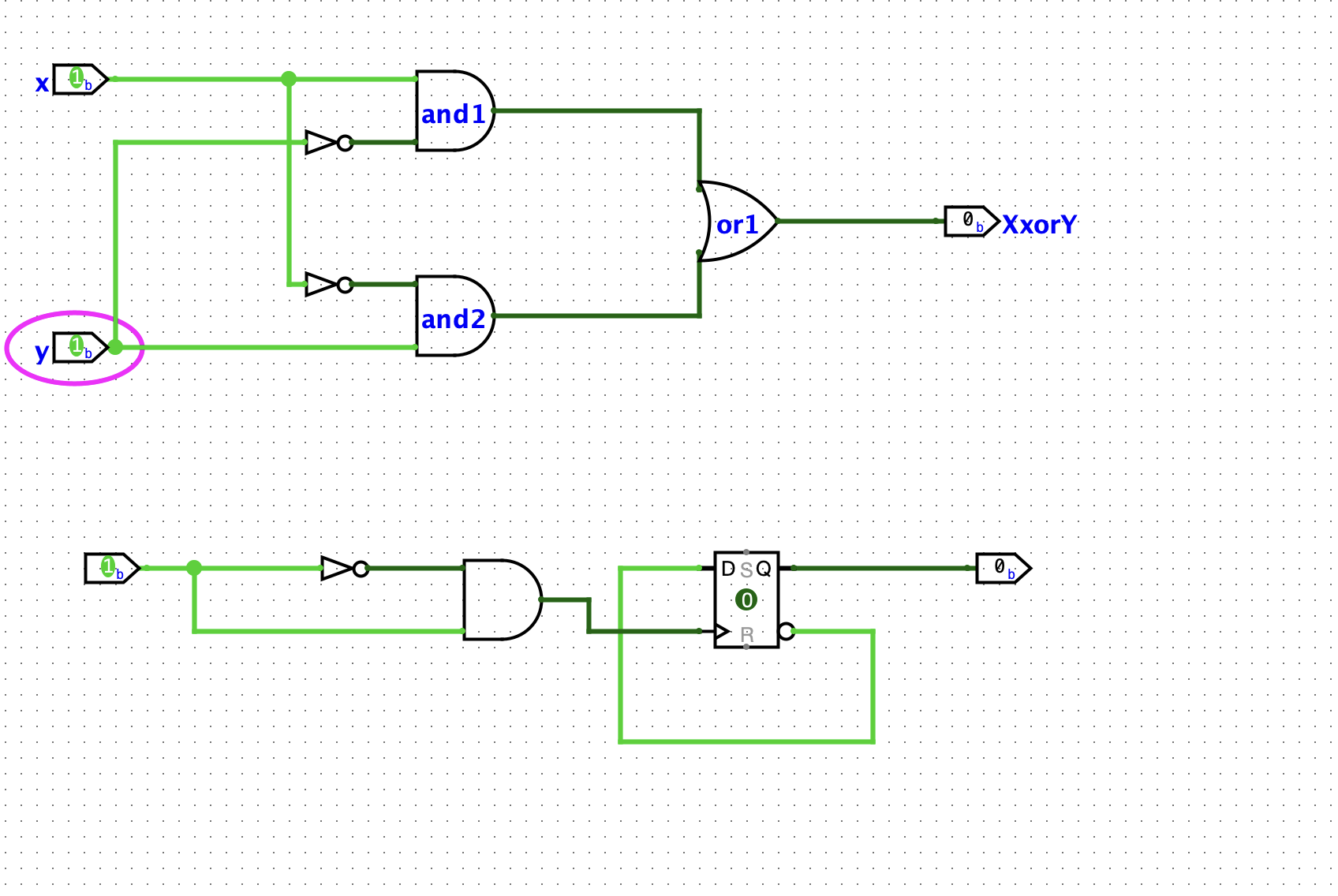

- 搭建异或门及对应晶体管数量

这个在我F.2的guide阶段就已经做了,所以就不重复了。用了两个非门,两个与门,一个或门。按照我们实现的或门(或非门+非门=5个晶体管)来算的话,一共用了 2 * 1 + 6 * 2 + 5 = 19 个晶体管。

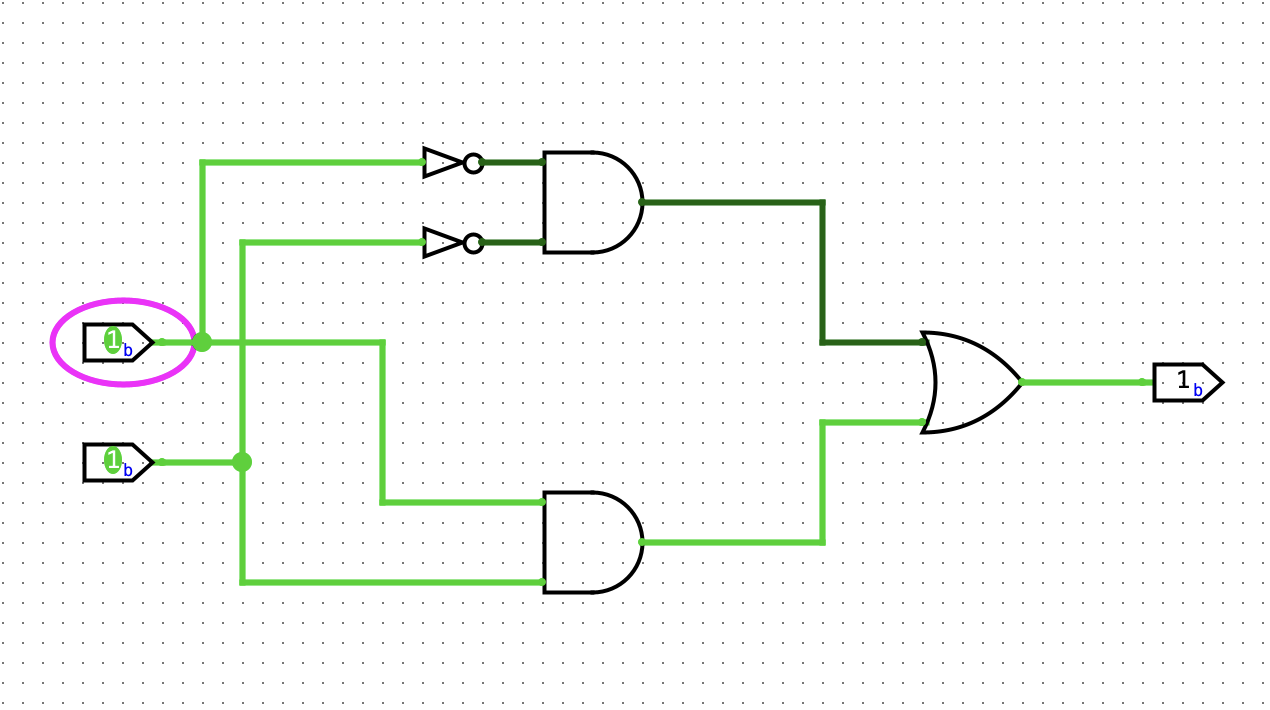

- 搭建同或门

可以简单的通过在 异或 门后面加一个 非门,但是我想通过真值表来试试看先。

| A | B | C |

|---|---|---|

| 0 | 0 | 1 |

| 1 | 1 | 1 |

| 0 | 1 | 0 |

| 1 | 0 | 0 |

算出来 Y=(~A&~B)|(A&B)

理论知识

- 真值表

原来我前面不知不觉中使用的方法是叫真值表,而通过真值表得出逻辑表达式的方法如下:

对所有输出为1的表项,将将每一个输入都变为1(取反或者不取反)后,进行或操作就是我们需要的表达式。

为什么是对的?因为输出要么为0,要么为1。将所有可能使得输出为1的可能进行 合并(或) 操作之后,得到的就是正确的表达式了。

二进制和十六进制

这个我会,就不记了。

组合逻辑电路

译码器

2-4 译码器

首先求出 Y0-Y3 的输出。

Y3 = A1 & A0

Y2 = A1 & ~A0

Y1 = ~A1 & A0

Y0 = ~A1 & ~A0

搭建如下,加了一个使能脚,主要是为了后面的3-8译码器使用

子电路功能

看 2-4 译码器扩展为 3-8 译码器的操作。就是一个 circuit 作为一个模块。

把2-4译码器拓展为3-8译码器

搭建如下,同样的,也有一个使能脚。

转码器 - 是一种特殊的译码器

定义: 可以按照指定的规则将一种编码的输入转换成另一种编码的输出。

七段数码管译码器1

下面是七段数码管的引脚与显示的对应关系图。

a

---

f| g |b

---

e| |c

--- .h

d

得出真值表

| 数字 | b3 | b2 | b1 | b0 | a | b | c | d | e | f | g | h |

|---|---|---|---|---|---|---|---|---|---|---|---|---|

| 0 | 0 | 0 | 0 | 0 | 1 | 1 | 1 | 1 | 1 | 1 | 0 | 0 |

| 1 | 0 | 0 | 0 | 1 | 0 | 1 | 1 | 0 | 0 | 0 | 0 | 0 |

| 2 | 0 | 0 | 1 | 0 | 1 | 1 | 0 | 1 | 1 | 0 | 1 | 0 |

| 3 | 0 | 0 | 1 | 1 | 1 | 1 | 1 | 1 | 0 | 0 | 1 | 0 |

| 4 | 0 | 1 | 0 | 0 | 0 | 1 | 1 | 0 | 0 | 1 | 1 | 0 |

| 5 | 0 | 1 | 0 | 1 | 1 | 0 | 1 | 1 | 0 | 1 | 1 | 0 |

| 6 | 0 | 1 | 1 | 0 | 1 | 0 | 1 | 1 | 1 | 1 | 1 | 0 |

| 7 | 0 | 1 | 1 | 1 | 1 | 1 | 1 | 0 | 0 | 0 | 0 | 0 |

| 8 | 1 | 0 | 0 | 0 | 1 | 1 | 1 | 1 | 1 | 1 | 1 | 0 |

| 9 | 1 | 0 | 0 | 1 | 1 | 1 | 1 | 1 | 0 | 1 | 1 | 0 |

| 其它 | x | x | x | x | 0 | 0 | 0 | 0 | 0 | 0 | 0 | 1 |

求出值关系

n0 = (~b3&~b2&~b1&~b0)

n1 = (~b3&~b2&~b1&b0)

n2 = (~b3&~b2&b1&~b0)

n3 = (~b3&~b2&b1&b0)

n4 = (~b3&b2&~b1&~b0)

n5 = (~b3&b2&~b1&b0)

n6 = (~b3&b2&b1&~b0)

n7 = (~b3&b2&b1&b0)

n8 = (b3&~b2&~b1&~b0)

n9 = (b3&~b2&~b1&b0)

# 可以看出来,就是一个 4-16 译码器,我用两个 3-8 译码器搭起来

a = n0 | n2 | n3 | n5 | n6 | n7 | n8 | n9

b = n0 | n1 | n2 | n3 | n4 | n7 | n8 | n9

c = n0 | n1 | n3 | n4 | n5 | n6 | n7 | n8 | n9

d = n0 | n2 | n3 | n5 | n6 | n8 | n9

e = n0 | n2 | n6 | n8

f = n0 | n4 | n5 | n6 | n8 | n9

g = n2 | n3 | n4 | n5 | n6 | n8 | n9

h = ~(n0|n1|n2|n3|n4|n5|n6|n7|n8|n9)

最终搭建的电路如下:

七段数码管译码器2

基于上面的再做拓展,就简单了。

'''

a

---

f| g |b

---

e| |c

--- .h

d

'''

# for i in range(16):

# ni = 4_16_decoder(i)

# a-g 保持和上面的不变,h 没有用

# 增加使得对应管子亮的数字就行了

a = a | n10 | n12 | n14 | n15

b = b | n10 | n13

c = c | n10 | n11 | n13

d = d | n11 | n12 | n13 | n14

e = e | n10 | n11 | n12 | n13 | n14 | n15

f = f | n10 | n11 | n12 | n14 | n15

g = g | n10 | n11 | n13 | n14 | n15

总体上来说就是加了一个hex拓展。

有一个hex_enable的pin,当使能的时候,> 9 的输入会让晶体管显示 A ~ F.

不使能的时候,> 9 的输入会让晶体管显示为一个点。

编码器

16-4 编码器

啊,这里求真值表就过于复杂了。 从数字0-15, 列举下每一位下出现的bit就可以了。

Y0 = A1 | A3 | A5 | A7 | A9 | A11 | A13 | A15

Y1 = A2 | A3 | A6 | A7 | A10 | A11 | A14 | A15

Y2 = A4 | A5 | A6 | A7 | A12 | A13 | A14 | A15

Y3 = A8 | A9 | A10 | A11 | A12 | A13 | A14 | A15

搭建如下:

4-2 优先编码器

我一开始的想法是当高位有输入的时候,低位不管是什么都无效。所以我把低位的输入全都 & 了高位的 输入。

这样,当高位有输入时,低位的输入无效,就实现了 优先 的概念。

后面去参考了网上的资料。发现可以用下面的表达式实现

Y1 = a3 | a2

# 下面这个的意思就是说,当a2 为1,且a1为1的时候,Y0 不能为1,4-2优先编码 也就这一种特殊情况

Y0 = a3 | (~a2 & a1)

搭建为如下:

16-4 优先编码器

想法是这样的,先把16位数据分成4组。b15-b12,b11-b8,b7-b4,b3-b0。然后依次将它们通过一个4-2优先编码器。

很显然,当b15-b12 有数值A3时,结果应该输出 0xc + A3

否则当 b11-b8 有数值A2时,结果应该输出 0x8 + A2

否则当 b7-b4 有数值A1时,结果应该输出 0x4 + A1

否则当 b3-b0 有数值A0时,结果应该输出 0 + A0

0xc,0x8,0x4,0x0就是 (0x3,0x2,0x1,0x0) <<2 。就是把高组的是否有输出进行一次优先编码。

实现如下: 4-2 编码器加了 V 输出,就是对4个输入进行一次或

前导0/1的计算

- 前导0的计算:

优先编码器会给出最高位1的数值编码,所以只需要用 输出位数 - 这个数值 就是前面有多少个0的结果了。

比如说 4-2 优先编码器对 0100 的处理结果为 2,只需要用 0b11 - 0b10 就得出来 1的结果。

- 前导1的计算:

先取反,然后计算前导0就行了。

多路选择器

1位2选1选择器

这里给出我对这种命名方式的理解:

m位 n选1选择器

代表每一个输入有m位,共 n 个输入,从其中选出一个作为输出,输出也有m位。

3位4选1选择器

3位4选1选择器 就是4个3位输入,从中选出一路作为输出。

具体实现如下:

可切换进位计数制的七位选择器

这个实际上在我带有 hex 拓展的选择器中就已经做出来了。

这里的思路是,若干个1位2选1选择器。选择信号为拨码开关最高位。其它信号定义为如下:

h = h if s == 0 else 0

Ai = Ai if s == 1 else 0 # (15>=i>=10)

实现在这儿

搭建4位比较器

如果两个4位二进制数相同,那么点亮LED灯。

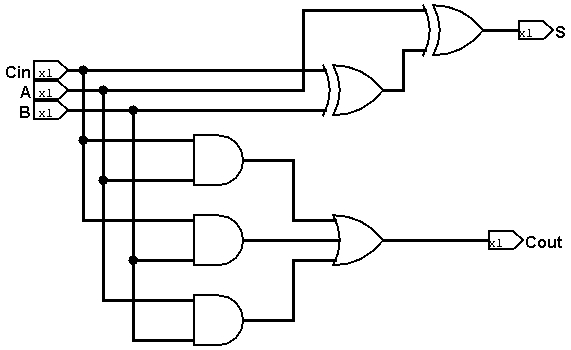

加法器

搭建1位全加器

真值表

| A | B | Cin | S | Cout |

|---|---|---|---|---|

| 0 | 0 | 0 | 0 | 0 |

| 0 | 0 | 1 | 1 | 0 |

| 0 | 1 | 0 | 1 | 0 |

| 0 | 1 | 1 | 0 | 1 |

| 1 | 0 | 0 | 1 | 0 |

| 1 | 0 | 1 | 0 | 1 |

| 1 | 1 | 0 | 0 | 1 |

| 1 | 1 | 1 | 1 | 1 |

由此可以得出关系

S = A ^ B ^ Cin

Cout = (A&B) | (B&Cin) | (A&Cin)

搭建如下:

用1位半加器搭建1位全加器

先搭建出来半加器

用数学进行分析:

- 首先 A 和 B 进行半家,得到进位C1和S1

- S1要输入Cin再次进行一次半加,得到进位C2和S2

- 最终的S肯定为S2,而最终的C可以是C1和C2半加结果的S,也可以是C1|C2(因为C1和C2肯定不会同时为1),也可以是C1^C2。

我这里最终的C是从C1和C2的半加来的。

搭建4位全加器和校验

整数的机器码表示

4位减法器

参考4位加法器,得先设计一下1位减法器(a1-a0-borrow)。写出真值表

| A1 | A0 | Bin | D | Bout |

|---|---|---|---|---|

| 0 | 0 | 0 | 0 | 0 |

| 0 | 0 | 1 | 1 | 1 |

| 0 | 1 | 0 | 1 | 1 |

| 0 | 1 | 1 | 0 | 1 |

| 1 | 0 | 0 | 1 | 0 |

| 1 | 0 | 1 | 0 | 0 |

| 1 | 1 | 0 | 0 | 0 |

| 1 | 1 | 1 | 1 | 1 |

得出关系:

D = (~A1 & ~a0 & bin) | (~A1 & a0 & ~bin) | (A1 & ~a0 & ~bin) | (A1 & a0 & bin)

bout = (~A1 & ~a0 & bin) | (~A1 & a0 & ~bin) | (~A1 & a0 & bin) | (A1 & a0 & bin)

搭建出一位全减器,如下:

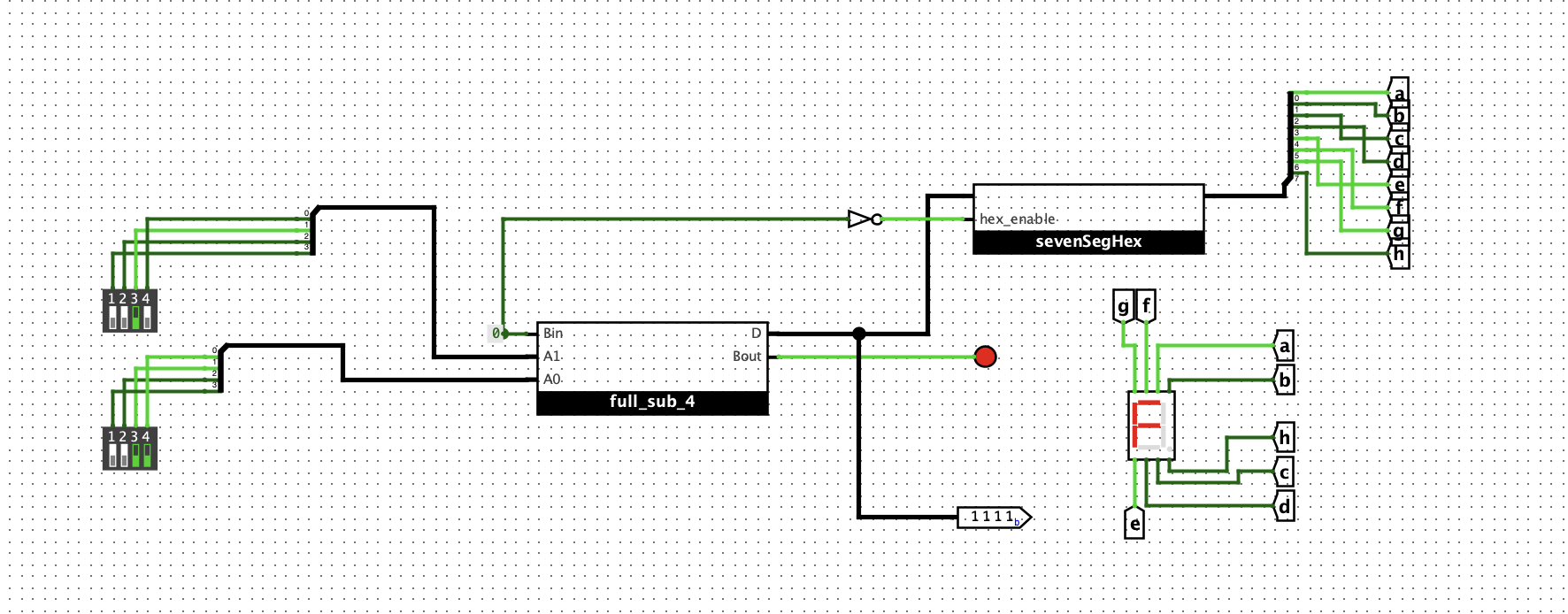

然后搭建出4位全减器,如下:

验证如图:

0x2 - 0x3 = 0xf, borrow 1

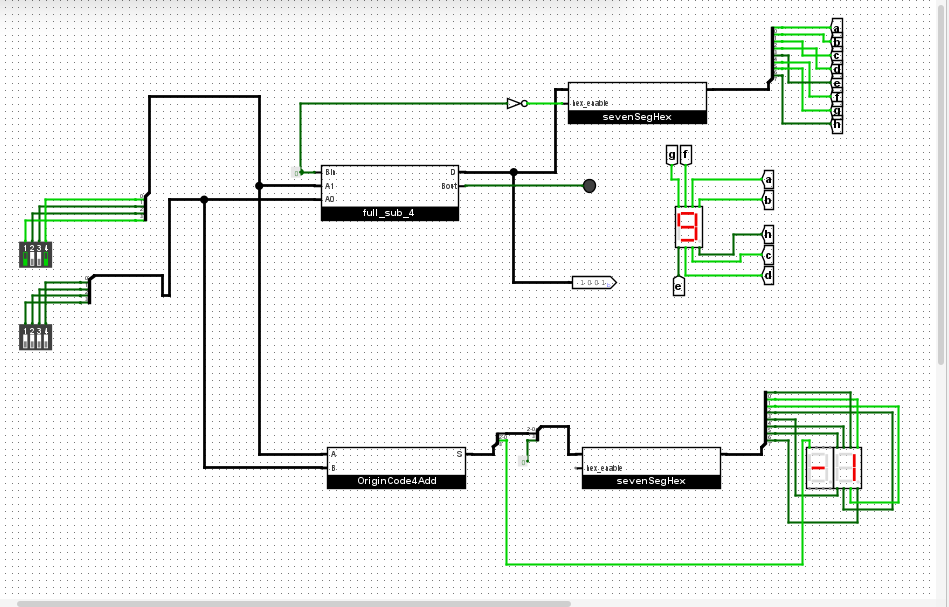

4位原码加法器

按照前面几种情况的分析,计算原码时,首先要选出符号位,然后对剩下的数据位,要么进行加,要么进行减。

具体规则是:

- 两个正数AB相加: 数据位A3+B3,符号位为0 (00)

- 大正数A加小负数B: 数据位A3-B3,符号位为0 (01)

- 小正数A加大负数B: 数据位B3-A3,符号位为1 (10)

- 两个负数相加,数据位A3+B3,符号位为1 (11)

- 这里假设了A一定是正数,当A不是正数时,就把A和B换个顺序

这样的话,按下面的进行设计:

- 先把输入进行选择,在输入有正数时,A永远是正数

- 计算出 A3+B3, A3-B3, B3-A3

- 拼凑一下四种输出结果

- 拿出(A4与B4),组合成为 B4A4, 作为选择子,对四种结果进行选择。

设计如下:

验证如下:

四位反码加法器

按照思路: 先把反码转换为真值等价的原码,然后使用原码加法器计算结果, 再将结果转换为真值等价的反码进行设计。

结果如下:

搭建4位反码加法器(2)

嗯,发现如果是负数的情况下,RCA所得结果再加一个1就是正确结果了。

这就是补码的概念吧。这里就不做了。

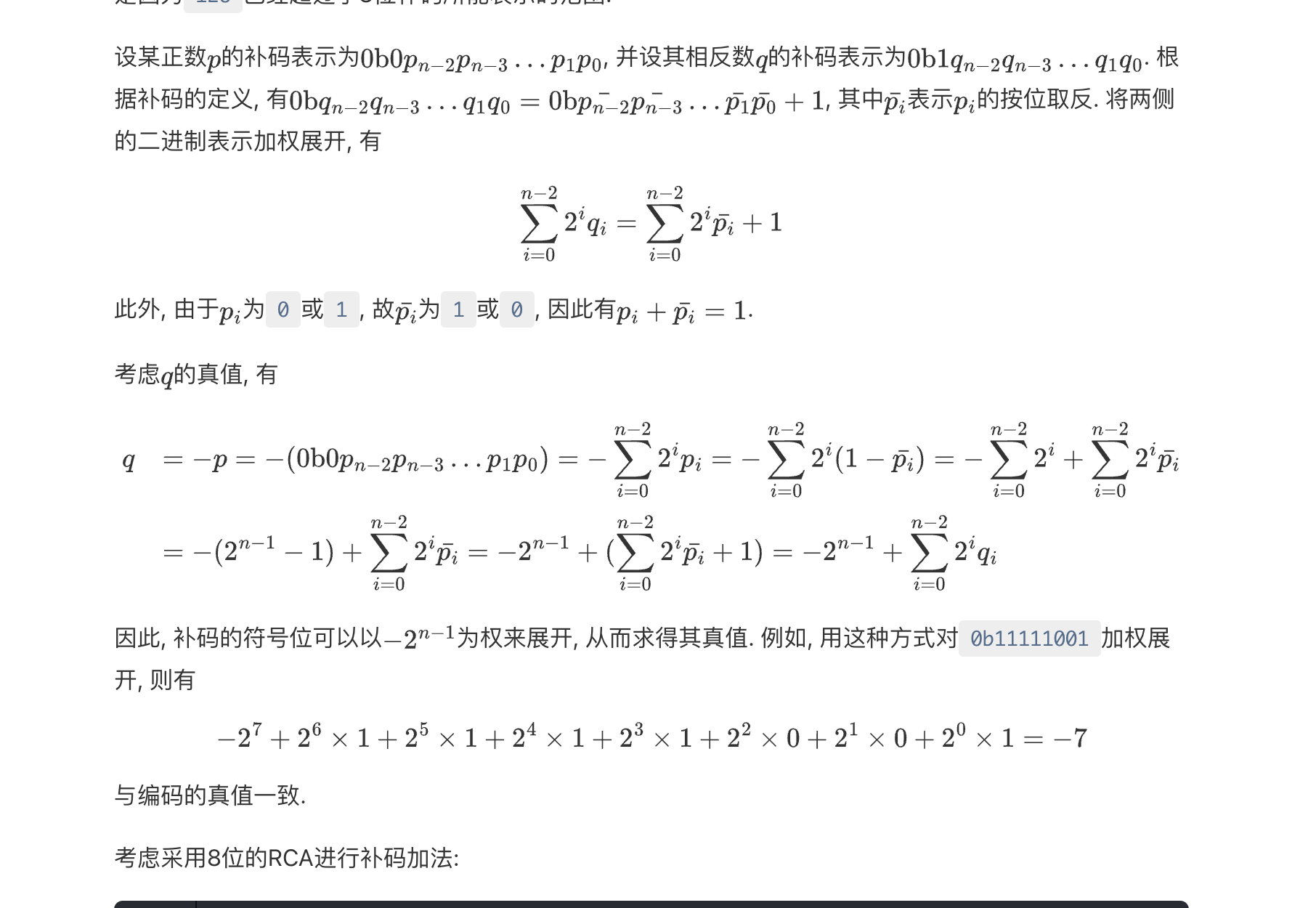

补码的疑问

教材中这段证明对我来说很突兀,这是尝试在说明什么问题呢?

问了 AI 之后,给出的解答是,这是在证明,为什么补码能够正确表示一个数的值。

当前正确表示也是有前提的,前提是这个补码最高位(符号位) 要被视为 -2^(n-1) * B(n-1)

检测补码加法是否发生溢出

先得出完整的真值表:

| An-1 | Bn-1 | Cn-1 | Cn | Sn-1 | 溢出 |

|---|---|---|---|---|---|

| 0 | 0 | 0 | 0 | 0 | 否 |

| 0 | 0 | 1 | 0 | 1 | 是 |

| 0 | 1 | 0 | 0 | 1 | 否 |

| 0 | 1 | 1 | 1 | 0 | 否 |

| 1 | 0 | 0 | 0 | 1 | 否 |

| 1 | 0 | 1 | 1 | 0 | 否 |

| 1 | 1 | 0 | 1 | 0 | 是 |

| 1 | 1 | 1 | 1 | 1 | 否 |

所以 溢出= An-1&Bn-1&~Sn-1 | ~An-1&~Bn-1&Sn-1

搭建如下:

时序逻辑电路

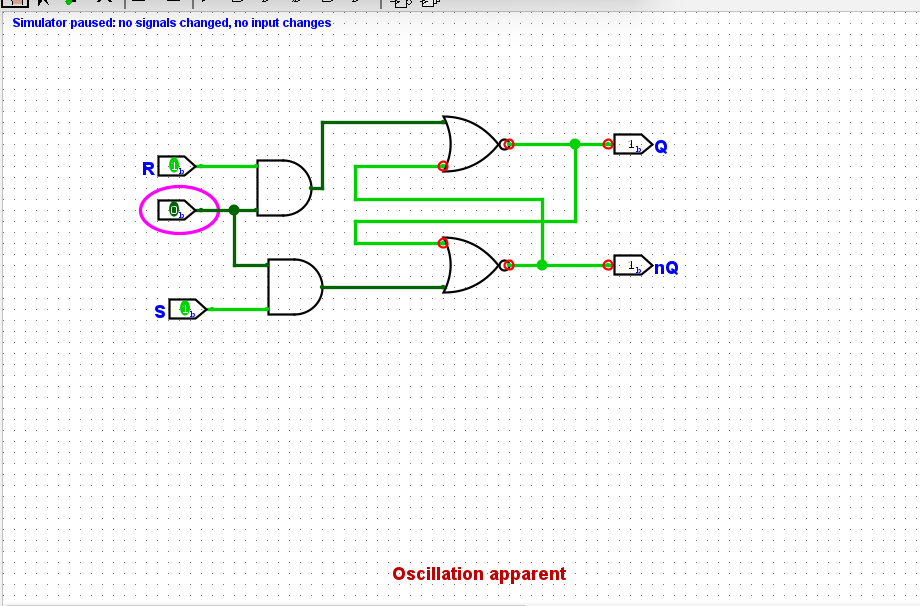

SR 锁存器

如下

oscillation apparent:

~S~R 锁存器

搭建如下:

行为如下:

- 当 R 为 0, S 为 1 时,上方与非门输出恒定为1,下方与非门输出恒为0. 此时Q为1, 故将SR锁存器存储的值更新为1。

- 当 R 为 1, S 为 0 时,下方与非门输出恒定为1,上方输出输出恒为0. 此时Q为0, 故将SR锁存器存储的值更新为0。

- 当 R 为 1, S 为 1 时,两个与非门的行为和反相器一致。此时锁存器的行为和交叉配对反相器一致, 故SR锁存器将保持之前存储的值。

- 当 R 为 0 ,S 为 0 时,两个门的输出均为1。并且从 sr 从 00 变为 11 时,锁存器进入震荡的亚稳态。

分析D锁存器的行为

通过分析 WE 是否使能开始:

- WE 使能,则 S = D, R = not D. 这种情况下如果D是1,那么Q为1; D是0的话, Q为0,也就是说 Q = D.

- WE 不使能,则S = 0,R = 0. 这种情况下,Q将保持。

就是说,S 和 R 同时为1的情况就不存在了。自然 11 到 00 的跳变也不会存在。

真值表如下:

| WE | D | Q |

|---|---|---|

| 0 | x | hold |

| 1 | 1 | 1 |

| 1 | 0 | 0 |

搭建D锁存器

带复位功能的D锁存器

这个reset是低电平有效的

用D锁存器实现位翻转功能

D = ~D, 在输入没有变化的时候,输出一直在反转,所以仿真程序认为出现了震荡。

D 触发器

带复位功能的D触发器

将主和子锁存器的Reset连接到Reset信号就可以了

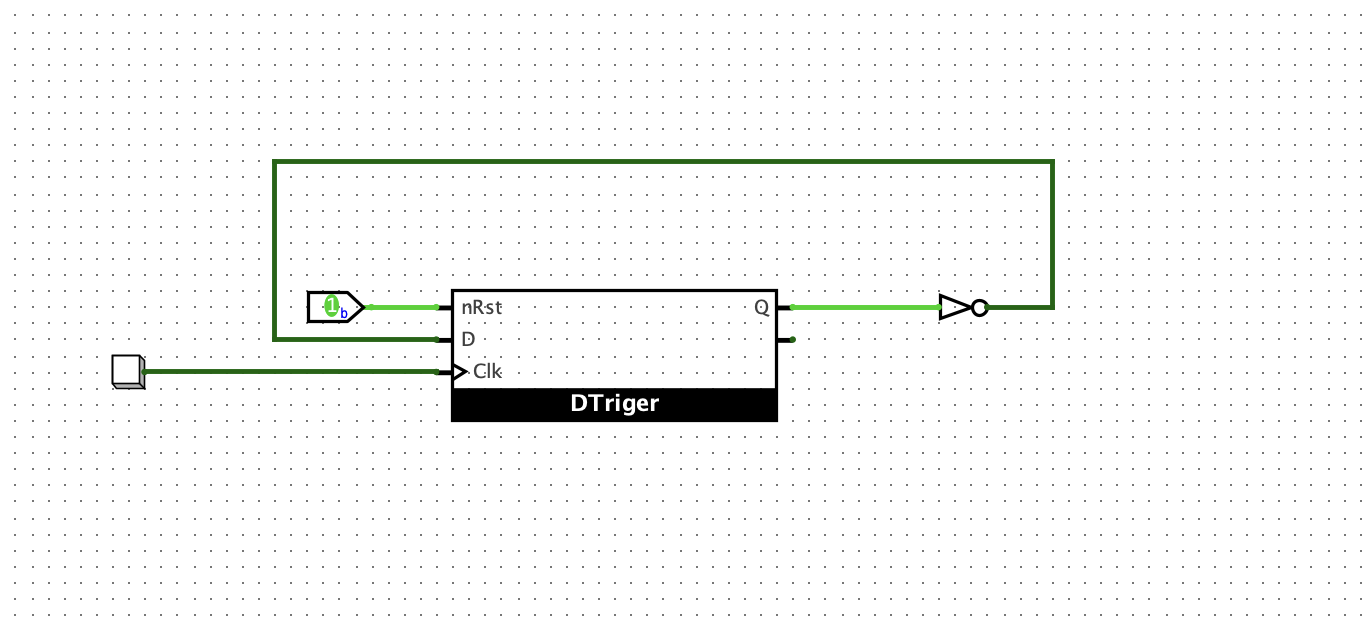

D触发器实现位翻转功能

下降沿触发的D触发器

有下面两种方式:

- 主锁存器的CLK信号输入不取反,子锁存器的CLK信号取反

- 将上升沿的D触发器的CLK信号取反

搭建带使能端的D触发器

想法是对CLK进行一次 与 操作,就是当 EN 为0时,CLK的变化被忽略。

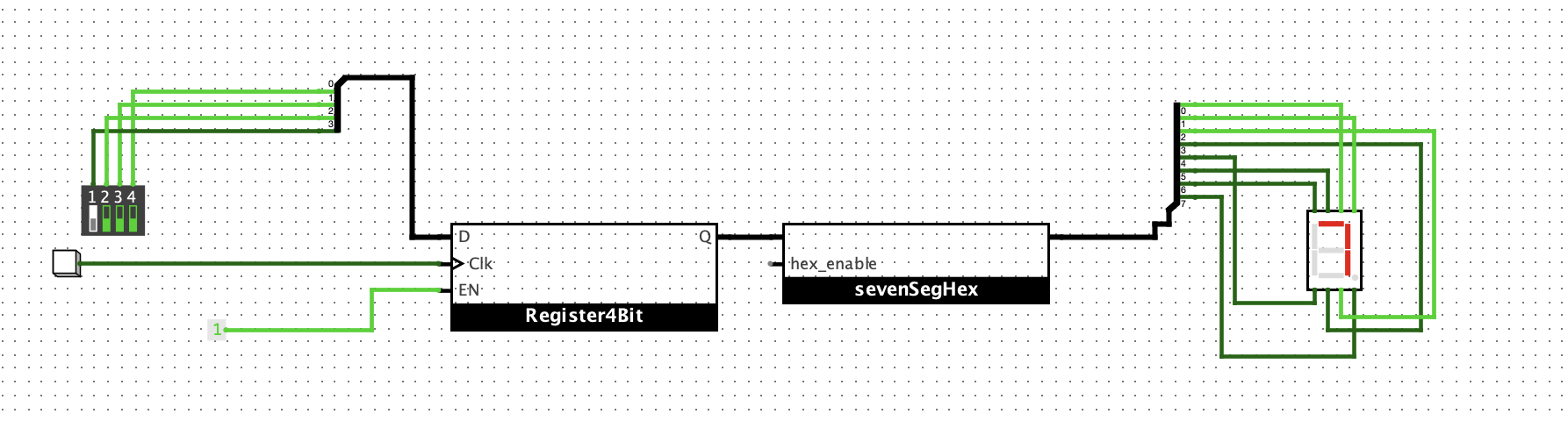

4位寄存器

验证如下: 输入的值不会马上生效,必须等到按一下button才会显示在数码管上。

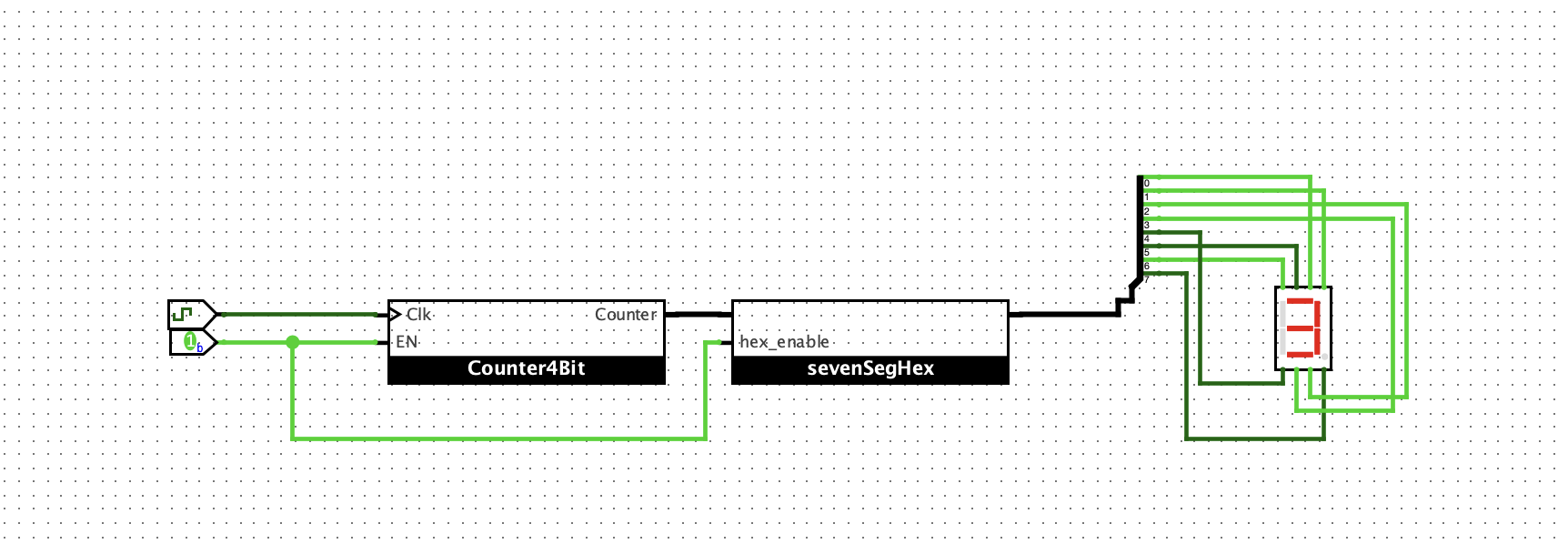

搭建4位计数器

想法是这样的: 每一个 clk 来的时候,v = v + 1。 也就是说,当clk来的时候,寄存器将上一次求和的值刷新到新的Q,然后把这个Q+1作为输入,等待下一次的时钟。

如下:

验证如下:

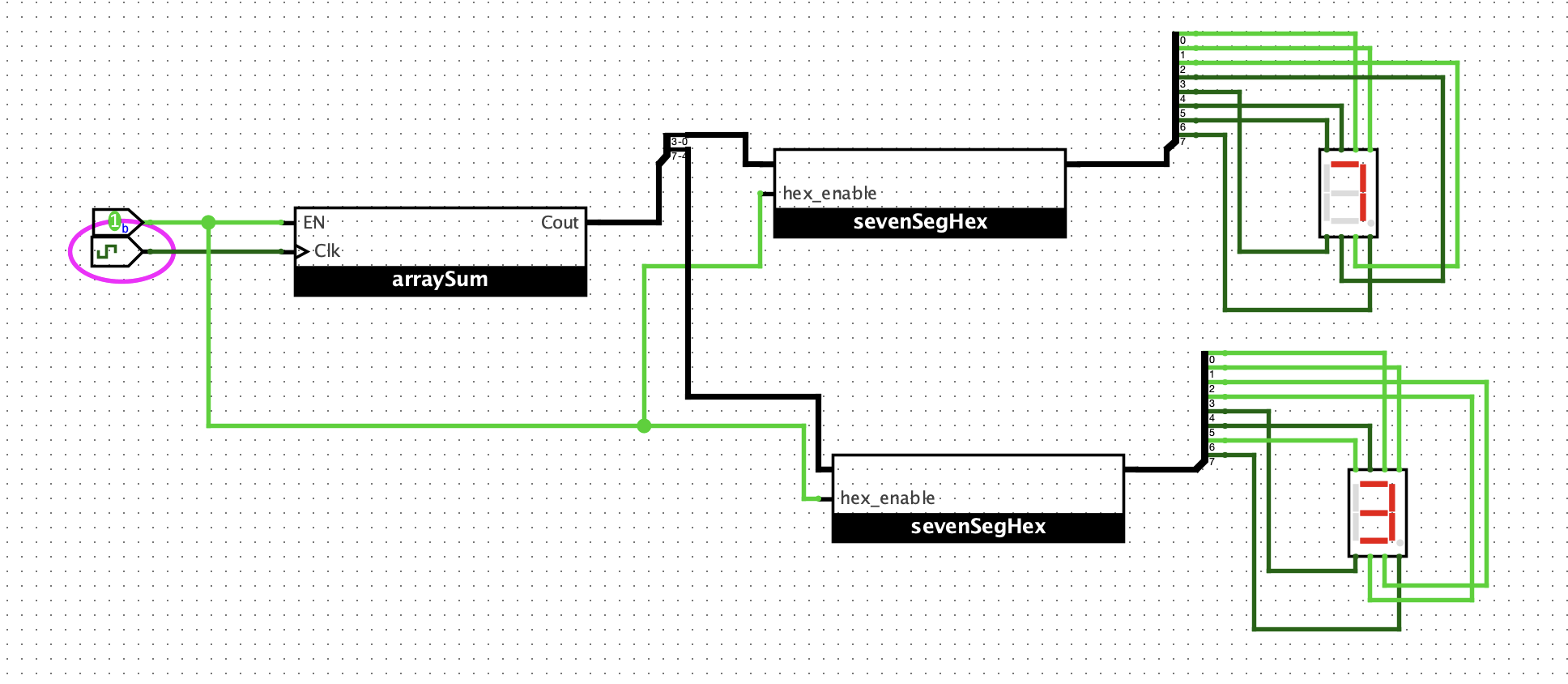

设计数列求和电路

先前设计的修改

- 发现先前设计的sr寄存器有概率仿真开始的时候就出现震荡,所以我在R加了一个 POR 信号。这样就稳定多了

- 扩展了8位寄存器和8位全加器

- 修正 DLatch, En信号不应该直接与 CLK 信号进行 &,应该与 非/和原始信号分别 &

设计如下:

- 加数从0开始递增,每一个clock递增1

- sum初始值为0,每一个clock与加数进行相加

- 时钟产生10个tick后,输出结果

验证如下: 输出 1+2+3+…+10 = 0x37

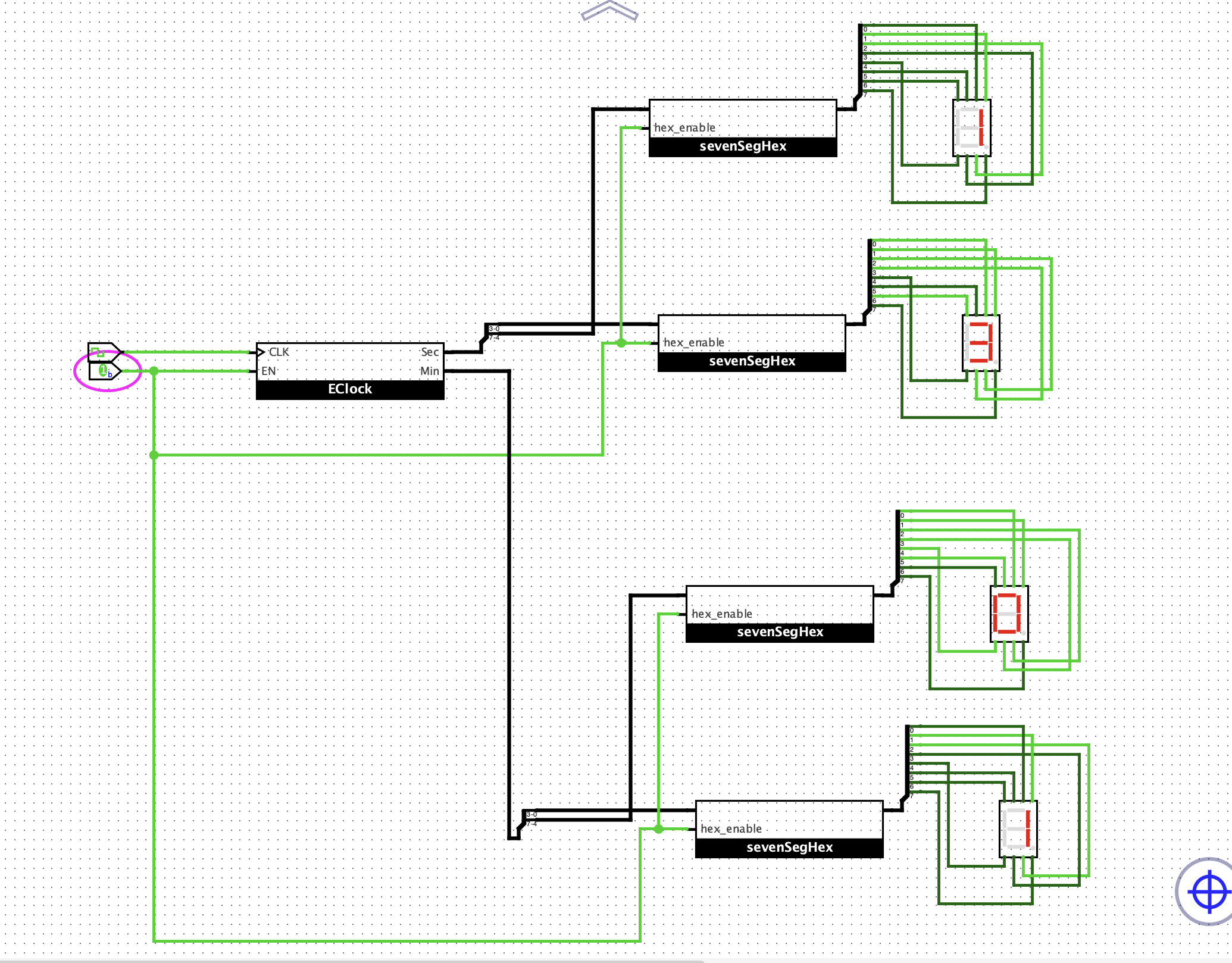

实现电子时钟

想法如下:

- 2个8位累加器 分别代表 秒和分

- 设计8位比较器

- 秒累加器的输出等与60时,产生一次分的clk,让分累加器 +1,然后将秒累加器的输出复位

- 分累加器的输出等与60时,将分累加器的输出复位

实现如下:

验证如下:

note: 为了方便,我这里没有做10分的显示,用了两个16进制的显示。

attention:

加了复位电路也没有办法完全解决震荡问题,我的版本如下:

Product: Logisim-evolution v4.1.0

Runs on: Java HotSpot(TM) 64-Bit Server VM v25.0.2

Compiled: 2026-02-15T09:21:41+0100

Build ID: main/632d66dc

Built on: Java HotSpot(TM) 64-Bit Server VM v25.0.2

问了ai,建议是使用内置的srlatch,我单步调试过,貌似目前每一步会吧Q或者~Q的状态置为不确定,然后反复进行计算。

用当前我的电路时,只会在摆电路的时候出现震荡,如果有的话,复位再重新仿真,就不会出现问题。

high performace network

tcpdump 研究

想研究下tcpdump,主要是以下几点:

- bpf/ebpf 程序加载过程

- 用户态程序与内核之间的数据流分析

- 给我的基于DPDK的用户态抓包程序进行修改

gemini 给的的意见

我先让ai给我生成一下调研的大概方向,这是它给出的。令我意外的是, dpdk竟然还支持了用户态的ebpf-runtime,这里可以作为额外增加的一点调研方向。

当然,这是一个非常专业和有深度的研究目标。tcpdump 的架构是网络分析的基石,而将其思想与 DPDK 结合,则是通向高性能用户态网络处理的关键。

下面我为您设计一份分步、可行的研究方案。

宏观架构概览:tcpdump 是如何工作的?

在深入细节之前,我们先建立一个心智模型。tcpdump 的工作流程可以简化为以下几个核心组件的协作:

用户接口 (CLI): 你输入的命令,如 tcpdump -i eth0 'tcp port 80'。

libpcap 库: 这是 tcpdump 的心脏和大脑。它负责:

解析过滤表达式: 将 'tcp port 80' 这种人类可读的字符串,编译成 BPF (Berkeley Packet Filter) 虚拟机能够理解的字节码。

设置抓包会话: 创建一个特殊的套接字 (AF_PACKET socket),并将其绑定到指定的网络接口 (eth0)。

加载过滤器: 将编译好的 BPF 字节码通过 setsockopt 系统调用附加到这个套接字上。

读取数据: 从内核为这个套接字准备的环形缓冲区 (Ring Buffer) 中高效地读取数据包。

内核:

AF_PACKET Socket: 提供一个原始接口,允许用户态程序直接访问链路层的数据包。

BPF 虚拟机 (JIT): 在内核中运行 libpcap 提供的 BPF 程序。当网络接口收到一个包后,数据会经过这个虚拟机。

过滤: 如果数据包不匹配 BPF 过滤器,内核会直接丢弃它,根本不会将其复制到用户态,这是性能优化的关键。

数据拷贝: 如果数据包匹配,内核才将其拷贝到 AF_PACKET socket 的共享内存环形缓冲区中。

tcpdump 主程序:

从 libpcap 提供的接口循环读取匹配的数据包。

解析包头(Ethernet, IP, TCP/UDP 等)。

按照用户指定的格式,将解析后的信息打印到标准输出。

可行的研究方案

我们将按照您的三个目标,分阶段进行研究,从理论到实践。

阶段一:深入理解 BPF 加载与内核交互 (目标 1 & 2)

这个阶段的目标是亲手验证上述模型的每一个环节。

1. 理论学习与工具准备

阅读文档:

man pcap-filter: 学习 tcpdump 过滤表达式的语法。这是 BPF 语言的前端。

man tcpdump: 重点关注 -d, -dd, -ddd 选项,它们可以让你看到 libpcap 编译出的 BPF 汇编指令。

工具:

tcpdump: 我们的主要研究对象。

strace: 系统调用追踪神器,用它来观察 tcpdump 和内核之间到底发生了什么。

2. 动手实践:解剖 BPF 加载过程

编译过滤器:

运行命令: tcpdump -i any -d 'tcp and port 80'

观察输出: 你会看到类似 BPF 汇编的指令,例如 ldh [12], jeq #0x800, ...。这证明了 libpcap 确实将字符串编译成了 BPF 程序。

你的任务: 理解这些指令的含义。ldh (load half-word) 是在加载以太网头中的协议类型字段,jeq (jump if equal) 是在判断协议是否为 IP (0x0800)。

追踪系统调用:

运行命令: sudo strace -e trace=socket,setsockopt,recvfrom,mmap tcpdump -i eth0 -c 1 'host 1.1.1.1'

观察输出,并寻找关键调用:

socket(AF_PACKET, SOCK_RAW, ...): 这就是在创建抓包用的原始套接字。

setsockopt(..., SOL_SOCKET, SO_ATTACH_FILTER, ...): 这就是 BPF 程序的加载点! strace 会显示一个结构体,其中包含了 BPF 指令的数量和指向指令数组的指针。

mmap(...): 这是 libpcap 现代版本中的关键优化。它将内核的环形缓冲区直接内存映射到 tcpdump 的进程空间,避免了每次 read() 都需要从内核空间向用户空间拷贝数据的开销。

recvfrom(...) 或 poll(...): tcpdump 等待内核通知有新数据包到达,并从映射的内存中直接读取。

3. 总结数据流

入向 (Ingress): NIC -> 内核协议栈 -> BPF 过滤器 (在 AF_PACKET socket 上运行) -> (如果匹配) -> 拷贝到 AF_PACKET 的环形缓冲区 -> tcpdump 通过 mmap 的内存区域直接读取。

核心: 过滤发生在内核态,且尽早发生,极大地减少了无用数据拷贝和上下文切换的开销。

阶段二:对比 tcpdump 模型与 DPDK 模型

在修改你的 DPDK 程序之前,必须深刻理解两者在哲学上的根本不同。

特性 tcpdump / libpcap 模型 DPDK (Data Plane Development Kit) 模型

控制平面 内核 (Kernel) 用户态 (Userspace)

驱动 内核标准驱动 用户态驱动 (PMD - Poll Mode Driver)

数据路径 内核旁路,但仍需内核调度和数据拷贝(或 mmap) 内核完全旁路 (Kernel Bypass)

包处理方式 中断驱动 + poll/select (阻塞等待) 轮询 (Polling),死循环检查网卡队列是否有包

CPU 使用 较低,只在有包到达时被唤醒 极高,通常会独占一个或多个 CPU 核心 100%

数据拷贝 至少一次从 NIC DMA 到内核内存,再到用户态(mmap 优化) 零拷贝 (Zero-Copy),网卡直接 DMA 到用户态分配的内存

易用性 非常高,一个 apt install 即可用 复杂,需要绑定网卡、配置大页内存、处理 NUMA

性能 数 Gbps,受限于上下文切换和内核处理 数十乃至上百 Gbps,只受限于内存带宽和 CPU 速度

结论: tcpdump 是请求内核帮忙过滤,而 DPDK 是**“踢开”内核,自己直接操作硬件**。

阶段三:为你的 DPDK 程序设计和实现过滤功能 (目标 3)

现在,你的目标是为你的 DPDK 程序增加类似 tcpdump 的强大过滤能力。DPDK 本身不提供类似 'tcp port 80' 这样的高级过滤语言。你有以下几种方案可以实现,从易到难:

方案 A: 硬编码或简单解析 (入门级)

在你的 DPDK 抓包循环中,直接用 C/Rust 代码检查包头。

c复制代码

// DPDK main loop

struct rte_mbuf *pkts[BURST_SIZE];

const uint16_t nb_rx = rte_eth_rx_burst(port_id, 0, pkts, BURST_SIZE);

for (int i = 0; i < nb_rx; i++) {

struct rte_ether_hdr *eth_hdr = rte_pktmbuf_mtod(pkts[i], struct rte_ether_hdr *);

if (eth_hdr->ether_type == rte_cpu_to_be_16(RTE_ETHER_TYPE_IPV4)) {

// Check IP header for protocol, source/dest IP...

// Check TCP header for source/dest port...

// 如果匹配,则处理;否则,rte_pktmbuf_free(pkts[i])

} else {

rte_pktmbuf_free(pkts[i]);

}

}

优点: 简单直接,无外部依赖。

缺点: 不灵活,每次修改过滤规则都需要重新编译。

方案 B: 利用硬件过滤卸载 (性能最佳)

许多现代网卡支持硬件过滤 (Flow Director, 5-tuple filter 等)。你可以通过 DPDK 的 rte_flow API 将过滤规则编程到网卡硬件中。

优点: 性能最高,不匹配的包根本不会被 DMA 到主机内存,不消耗 CPU。

缺点: 并非所有网卡都支持,rte_flow API 相对复杂,支持的规则有限。

方案 C: 重用 libpcap 的编译器 + 用户态 BPF 解释器 (最灵活和强大)

这是最接近 tcpdump 思想的方案,强烈推荐。

链接 libpcap: 在你的 DPDK 项目中,包含 pcap.h 并链接 -lpcap。你只使用它的编译功能,不使用它的抓包功能。

获取 BPF 字节码:

c复制代码

#include <pcap/pcap.h>

// 假设 filter_string 来自用户输入,如 "tcp port 80"

const char *filter_string = "tcp port 80";

struct bpf_program fp;

// 使用 pcap_compile_nopcap 获取 BPF 程序,它不需要一个活动的 pcap_t 句柄

// DLT_EN10MB 表示链路层是 Ethernet

if (pcap_compile_nopcap(SNAPLEN, DLT_EN10MB, &fp, filter_string, 1, PCAP_NETMASK_UNKNOWN) < 0) {

// 错误处理

}

// 现在 fp.bf_insns 里就是编译好的 BPF 字节码

在用户态运行 BPF: DPDK 自带一个 BPF 库,可以加载并执行 BPF 程序。

c复制代码

#include <rte_bpf.h>

// 创建 BPF 执行上下文

struct rte_bpf *bpf_ctx = rte_bpf_load(&fp);

pcap_freecode(&fp); // 释放 libpcap 分配的资源

// ... 在你的 DPDK 抓包循环中 ...

for (int i = 0; i < nb_rx; i++) {

// 从 mbuf 中获取数据包的指针和长度

void *pkt_data = rte_pktmbuf_mtod(pkts[i], void *);

uint32_t pkt_len = rte_pktmbuf_data_len(pkts[i]);

// 在用户态执行 BPF 过滤

if (rte_bpf_exec(bpf_ctx, pkt_data, pkt_len) > 0) {

// 包匹配!进行处理...

} else {

// 包不匹配,释放

rte_pktmbuf_free(pkts[i]);

}

}

rte_bpf_destroy(bpf_ctx);

总结与建议

先完成阶段一,用 strace 和 tcpdump -d 把 libpcap 和内核的交互流程摸得滚瓜烂熟。

深刻理解阶段二的对比表格,明确你的 DPDK 程序在生态位上的不同。

直接上手实现阶段三的方案 C。这是最能体现你学习成果的方案,它完美地将 libpcap 的易用前端与 DPDK 的高性能后端结合在了一起,让你的程序既强大又灵活。

祝你研究顺利!这是一个非常有价值的技术深潜。

嗯,还比较合理。所以先从 strace 开始吧。

看看在输入 tcpdump -i bond0 'port 8888' 这个命令之后,整个程序都干啥了。

strace tcpdump -i bond0 ‘port 8888’

这个日志会很多,节选了一些我认为关键的部分。然后加了一些注释,即我认为它在干什么。

//...

// 早期启动阶段,说明tcpdump依赖 libpcap 库

openat(AT_FDCWD, "/usr/lib64/libpcap.so.1", O_RDONLY|O_CLOEXEC) = 3

...

// 一个 raw socket,用于后续操作

socket(AF_PACKET, SOCK_RAW, htons(0 /* ETH_P_??? */)) = 4

ioctl(4, SIOCGIFINDEX, {ifr_name="lo", ifr_ifindex=1}) = 0

ioctl(4, SIOCGIFHWADDR, {ifr_name="bond0", ifr_hwaddr={sa_family=ARPHRD_ETHER, sa_data=50:79:73:0d:9b:ed}}) = 0

// 开启混杂模式

setsockopt(4, SOL_PACKET, PACKET_ADD_MEMBERSHIP, {mr_ifindex=if_nametoindex("bond0"), mr_type=PACKET_MR_PROMISC, mr_alen=0, mr_address=50:79:73:0d:9b:ed}, 16) = 0

// 准备ringbuf

setsockopt(4, SOL_PACKET, PACKET_AUXDATA, [1], 4) = 0

getsockopt(4, SOL_SOCKET, SO_BPF_EXTENSIONS, [64], [4]) = 0

mmap(NULL, 266240, PROT_READ|PROT_WRITE, MAP_PRIVATE|MAP_ANONYMOUS, -1, 0) = 0x7faf62328000

getsockopt(4, SOL_PACKET, PACKET_HDRLEN, [48], [4]) = 0

setsockopt(4, SOL_PACKET, PACKET_VERSION, [2], 4) = 0

setsockopt(4, SOL_PACKET, PACKET_RESERVE, [4], 4) = 0

setsockopt(4, SOL_PACKET, PACKET_RX_RING, 0x7fff1856bb30, 28) = 0

mmap(NULL, 2097152, PROT_READ|PROT_WRITE, MAP_SHARED, 4, 0) = 0x7faf61a00000

// 开始attach filter

bind(4, {sa_family=AF_PACKET, sll_protocol=htons(ETH_P_ALL), sll_ifindex=if_nametoindex("bond0"), sll_hatype=ARPHRD_NETROM, sll_pkttype=PACKET_HOST, sll_halen=0}, 20) = 0

setsockopt(4, SOL_SOCKET, SO_ATTACH_FILTER, {len=24, filter=0x55ea646ae0d0}, 16) = 0

datapath优化

可以看到,tcpdump抓包是用了 packet mmap 的方法。 主要是这么几步:

[setup] socket() -------> creation of the capture socket

setsockopt() ---> allocation of the circular buffer (ring)

option: PACKET_RX_RING

mmap() ---------> mapping of the allocated buffer to the

user process

[capture] poll() ---------> to wait for incoming packets

[shutdown] close() --------> destruction of the capture socket and

deallocation of all associated

resources.

它比直接读写fd,就是少了一次从内核态到用户态的数据拷贝。感觉这里带来的性能提升应该还是很可观的。 不知道 rust 的标准库是不是采用的这个方法?我觉得应该不是,不然的话标准库可能得实现一套完整的协议栈了。 这里留个坑,我觉得可以做下这两种情况下的性能对比。

libpcap 生成过滤条件

由于 libpcap 是用户态的,strace 现在还不能看具体是干了什么。不过我知道好像 ftrace 可以?

anyway, 先尝试看看源码和文档,看看 libpcap 对于这种 ‘port 8888’ 具体会生成什么东西。

bpf 分析

[root@localhost ~]# tcpdump -i bond0 -d "port 8888"

(000) ldh [12]

(001) jeq #0x86dd jt 2 jf 10

(002) ldb [20]

(003) jeq #0x84 jt 6 jf 4

(004) jeq #0x6 jt 6 jf 5

(005) jeq #0x11 jt 6 jf 23

(006) ldh [54]

(007) jeq #0x22b8 jt 22 jf 8

(008) ldh [56]

(009) jeq #0x22b8 jt 22 jf 23

(010) jeq #0x800 jt 11 jf 23

(011) ldb [23]

(012) jeq #0x84 jt 15 jf 13

(013) jeq #0x6 jt 15 jf 14

(014) jeq #0x11 jt 15 jf 23

(015) ldh [20]

(016) jset #0x1fff jt 23 jf 17

(017) ldxb 4*([14]&0xf)

(018) ldh [x + 14]

(019) jeq #0x22b8 jt 22 jf 20

(020) ldh [x + 16]

(021) jeq #0x22b8 jt 22 jf 23

(022) ret #262144

(023) ret #0

指令本身还是很好理解的,但是类似于 [12],这种指向的是哪儿呢?可能还需要去看看BPF调用规范。

- BPF engine and instruction set

btw,我之前做过nes的simulator,所以对这三个参数倍感亲切,

-

首先描述寄存器

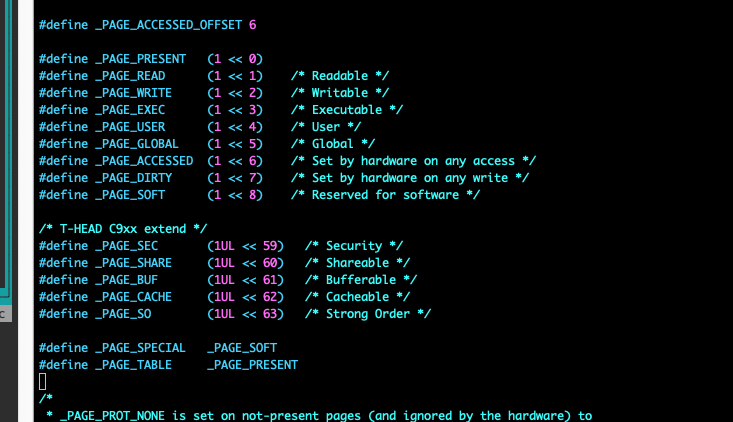

bpf不像epbf,寄存器很简单,只有一个32位的 A(累加) 寄存器,一个32位的 X 寄存器,16个32位的M[i]寄存器

-

指令 (linux/filter.h以及 linux/bpf_common.h )

就不搬了,常见的 load/store/je/jne, 对于算数有 add/sub/mul/div/neg/mod/xor 等 filter.h 中还定义了额外的一些linux上的扩展,用于获取 socket buffer 的额外信息等。

-

address mode

一共有 12 种,之前疑惑的 [k] 这样的是mode 4,代表

BHW at byte offset k in the packet。 看看其它访问内存的mode,都是以数据包的地址作为基础地址。这么说起来 cBPF 只是为了抓包而生的,因为别的内存它都访问不到。返回支持返回立即数和A寄存器。

参考kernel文档

-

host 8888bpf code分析现在分析这个就很直观了,伪代码大致如下:

int filter(char *pkt) { if (((u16*)ptr)[12/2] == 0x86dd) { // ipv6 case if (ptr[20] == 0x11||ptr[20] == 0x6 || ptr[20] == 0x84) { // tcp, udp or stcp u16 sport = *(u16*)&ptr[54]; u16 dport = *(u16*)&ptr[56]; if (sport == 8888 || dport == 8888) { return 262144; } } } else if (((u16*)ptr)[12/2] == 0x0800) { // ipv4 if (ptr[23] == 0x11||ptr[23] == 0x6 || ptr[23] == 0x84) { if (*(u16*)&ptr[20]&0x1fff == 0) { // fragment offset == 0 u8 hdr_len = ptr[14]*0xf * 4; u16 sport = *(u16*)&ptr[14+hdr_len]; u16 dport = *(u16*)&ptr[14+hdr_len]; if (sport == 8888 || dport == 8888) { return 262144; } } } } return 0 }

kernel bpf attach

setsockopt(4, SOL_SOCKET, SO_ATTACH_FILTER, {len=24, filter=0x55ea646ae0d0}, 16) = 0

这里,应该就是把上面的BPF code attach到kernel。不过内核似乎不是真正的接受这种 BPF 码。 它接受了一个结构体,描述了这些码的格式。

struct sock_filter { /* Filter block */

__u16 code; /* Actual filter code */

__u8 jt; /* Jump true */

__u8 jf; /* Jump false */

__u32 k; /* Generic multiuse field */

};

struct sock_fprog { /* Required for SO_ATTACH_FILTER. */

unsigned short len; /* Number of filter blocks */

struct sock_filter __user *filter;

};

{len=24, filter=0x55ea646ae0d0} 看这个参数,说明tcpdump传递给内核的一共是 24 个 sock_filter{}

其中的内容也可以和我们上面的分析对应:一共24条指令,一条指令对应一个结构体。

socket—fd 已经有 网卡的各种信息,那么具体的这个filter是被attach到什么点呢?以及kernel是怎么运行这个code的? 希望能够继续深入研究一下。

-

SO_ATTACH_FILTER attach point

这里除了看代码似乎没有什么别的好办法,大概画个流程图吧。

整个流程最主要的是将用户态传入的程序进行检查,然后选择一个jit runtime进行运行。 最终把socket的sk_filter置为jit code。

而这个socket又是什么呢?在 net/socket.c 中可以看到,是 socket 这种fd的 privdata。在sys_socket系统调用时被创建。 具体的来说,通过 __sock_create 创建。

通过strace可以看出前面tcpdump创建的net_family为AF_PACKET,由此我们找到对应的create函数为 net / packet / af_packet.c :: packet_create

create 动作比较复杂,不过我觉得主要关心

po->prot_hook.func = packet_rcv这一行就可以。不对,set tx/rx ring的方法会把这个callback改为 tpacket_rcv,或许这才是我们要关注的。

setsockopt(syscall) -> __sys_setsockopt -> do_sock_setsockopt -> sock_setsockopt -> sk_setsockopt

-> sk_attach_filter -> __get_filter (jit happened)

-> __sk_attach_prog

-

callback point: tpacket_rcv

tpacket_rcv 调用 run_filter, 最终一路调用到run bpf code。获取完res值之后,如果res > 0,就说明这个包需要拷贝。

这里调用了skb_copy_bit(),把 skb 的数据拷贝到了ringbuf中,然后把status置上 TP_STATUS_USER 。这样,用户态就能访问到数据了。

那么这个tpacket_rcv会在哪里被调用呢?答案在 dev_add_pack, 对于 AF_PACKET/PF_PACKET,会在这种类型下注册一下这个packet_type

由此当 __netif_receive_skb_core 收到包时,首先进行 do_xdp_generic(通用xdp抓包点,也就是软件模拟的xdp), 也就是这种dev的packet type 进行 deliver_skb

list_for_each_entry_rcu(ptype, &dev_net_rcu(skb->dev)->ptype_all, list) { if (pt_prev) ret = deliver_skb(skb, pt_prev, orig_dev); pt_prev = ptype; } /// 这后面是 tc 点,所以也就是说 tcpdump 的挂载点是在 tc点之前的。 static inline int deliver_skb(struct sk_buff *skb, struct packet_type *pt_prev, struct net_device *orig_dev) { if (unlikely(skb_orphan_frags_rx(skb, GFP_ATOMIC))) return -ENOMEM; refcount_inc(&skb->users); return pt_prev->func(skb, skb->dev, pt_prev, orig_dev); } -

*** 对于内核函数,这种回调常常会让人觉得找不到callstack,我们可以利用 eBpf机制 来轻松的得到调用栈。 ***

对于这次情况,就可以通过 bpftrace -e 'kprobe:tpacket_rcv { print(kstack); }' 来得出调用栈帧:

[root@localhost ~]# bpftrace -e 'kprobe:tpacket_rcv { print(kstack); }'

Attaching 1 probe...

tpacket_rcv+1

__netif_receive_skb_core+1800

__netif_receive_skb_list_core+319

__netif_receive_skb_list+251

netif_receive_skb_list_internal+254

napi_complete_done+111

igb_poll+99

__napi_poll+39

net_rx_action+563

__do_softirq+198

__irq_exit_rcu+161

common_interrupt+67

asm_common_interrupt+34

# 另外启动一个shell,运行tcpdump,正常这个函数不会被调用。

- kernel jit compiler 从 __get_filter 开始,一路调用到 bpf_jit_compile,这个后面有需要再深入研究吧。

dpdk ebpf support

源代码位于 app/test/test_bpf.c 中,描述了一组 ebpf 测例。

实现代码大部分位于 lib/librte_bpf 下面,目前支持了两种模式,jit 和 interpreter。

但是这个代码目前看起来只是实现了执行的部分,更具体的,比如说想要把这个程序attach到某个netdev,以及ebpf map,似乎没有很好的支持。

我觉得这个可能更多的是做一些抓包工具,可能稍微修改一下就能使得现在的 tcpdump 工作在dpdk上。

文档也比较简陋,在后面看看是否能够作一些相关的有趣的事情。

lldp-tool

LLDP 是一种链路层协议,可以发现链路上的其它设备(需要其他设备同时开启)。

centos上安装lldp

yum install lldpd -y

systemctl start lldpd.service

查看 neighbour 信息

[root@localhost ~]# lldpcli show neighbors

-------------------------------------------------------------------------------

Interface: ens2f1np1, via: LLDP, RID: 2, Time: 0 day, 00:25:58

Chassis:

ChassisID: mac 90:74:2e:f0:a0:6e

SysName: xxxx

SysDescr: H3C Comware Platform Software, Software Version 7.1.070, Release 8307P10

H3C S6850-56HF-G

Copyright (c) 2004-2024 New H3C Technologies Co., Ltd. All rights reserved.

MgmtIP: 10.254.55.220

Capability: Bridge, on

Capability: Router, on

Port:

PortID: ifname HundredGigE1/0/49

PortDescr: HundredGigE1/0/49 Interface

TTL: 121

-------------------------------------------------------------------------------

ebpf gateway

some link:

业务场景

基于 epbf 技术做一个网关,这个网关主要处理 VPC 之间,以及VPC到经典网络之间的流量。

业务逻辑设计

- 三层转发,不需要 MAC 信息

- 基于路由的转发逻辑,VPC 内支持

- 策略路由(from xxx lookup table xxx),

- 自定义路由(ip r add xxx table xxx),

- 系统路由(ip route add xxx table main)

- VPC 内的VMNC信息,是 /32 or /128位的精准系统路由

- EIP 支持,1:1的公网ip

- NAT 支持,从 VPC网络 到 经典网络的转发支持

- 可观测性/可调试性

开发过程

- 控制面:

- 自然的接入k8s/restApi,

- 提供数据面热加载能力

- naive 读写 BPF map 能力支持

- 数据面

- 实现业务逻辑

- 挂载在 xdp 点: 可能有加速,就算没有加速,内核也有generic xdp可以使用。

结合团队开发情况,使用 Go + c 来开发。

数据面开发

-

maps design

- route table: LpmTrieMap

- key: vpcId + TableId + addr

- value: route action

- eip table(and reverse table): hashMap

- key: vpcId + Ip

- value: eip

- ct table: ringbuf?

- key: tuple(src,dst,srcport,dstport,proto)

- value: ct action

- sa pool table: ringbufMap

- key: none

- value: addr+port

- global ip: array

- key: index

- value: vip

- route table: LpmTrieMap

-

dp design

xdp ======= is_geneve ===y===> tunnel_process =====> nat_process: sa_pool fetch && ct create || ct reuse

|| || (in vpc)

|| ===============> Re-encap

|| ||

========> ct_lookup ==>

||

=======> to kernel

控制面开发

-

restApi compat, event driven

- eBpf maps write/read

- announce and revoke bgp

-

reload dp on startup (对于我们这种场景,不需要像cilium一样热编译代码)

cilium

学习一下cilium。

dpdk router

RRDMA

实现一个自己的 RDMA 虚拟网卡,纯软件模拟,基于 Rust 开发。类似 soft-roce,让普通以太网卡支持 RDMA/RoCE 协议。

技术选型

| 方案 | 选择 | 理由 |

|---|---|---|

| io_uring 用户态 | ✅ | 开发效率高、调试容易、生态成熟 |

| Rust 内核模块 | ⏸️ 待研究 | 研究价值高,但开发周期长 |

阶段一:Rust io_uring 基础操作

目标

掌握 io_uring 的基本使用,能够进行异步 I/O 操作。

学习路线

1. io_uring 概念入门

└── 理解 SQ (Submit Queue) 和 CQ (Completion Queue)

└── 理解 SQE (Submission Queue Entry) 和 CQE (Completion Queue Entry)

2. 基础 API 使用

├── 使用 io-uring crate 进行文件读写

├── 使用 tokio-uring 进行异步编程

└── 理解 registered buffers 和 fixed files

3. 网络 I/O

├── UDP socket 收发

└── 多队列和批量操作

参考资源

官方文档和教程

| 资源 | 链接 | 说明 |

|---|---|---|

| io-uring crate | https://docs.rs/io-uring/latest/io_uring/ | Rust io_uring 的官方 crate |

| tokio-uring | https://docs.rs/tokio-uring/latest/tokio_uring/ | Tokio 集成 io_uring |

| io_uring 官方文档 | https://unixism.net/2020/04/io-uring-by-example-1-introduction-to-io_uring/ | 完整的 io_uring 教程系列 |

开源示例

| 资源 | 链接 | 说明 |

|---|---|---|

| uring_examples | https://github.com/espoal/uring_examples | Rust io_uring 示例集 |

| uring-fs | https://docs.rs/uring-fs/latest/ | 异步文件系统操作 |

| tokio-uring 博客 | http://developerlife.com/2024/05/25/tokio-uring-exploration-rust/ | 详细的中文教程 |

关键概念

1. 提交队列 (Submit Queue)

- 应用提交 I/O 请求的地方

- SQE 包含操作类型、缓冲区指针、用户数据等

2. 完成队列 (Completion Queue)

- 内核返回 I/O 完成状态的地方

- CQE 包含结果状态、用户数据等

3. Registered Buffers

- 预先注册内存到内核,避免每次 I/O 拷贝

- 零拷贝发送的关键

4. Fixed Files

- 预先注册文件描述符,减少系统调用开销

实践任务

| 序号 | 任务 | 验收标准 |

|---|---|---|

| 1.1 | 安装 liburing 开发库 | apt install liburing-dev 成功 |

| 1.2 | 编译运行 io-uring 示例 | 文件读取成功 |

| 1.3 | 使用 tokio-uring 重写 | 异步读取文件 |

| 1.4 | UDP echo server | 能收发 UDP 包 |

| 1.5 | 使用 registered buffers | 实现零拷贝发送 |

阶段一检查点

- 理解 io_uring 的工作原理

- 能用 io-uring crate 进行文件读写

- 能用 tokio-uring 进行异步编程

- 能用 UDP socket 收发数据

- 理解 registered buffers 的使用场景

阶段二:基于 Rust 的 RoCEv2 协议实现

目标

实现完整的 RoCEv2 协议栈,包括 IB 传输层、UDP/IP 封装、以太网帧。

RoCEv2 协议栈结构

┌─────────────────────────────────────────────────────────────┐

│ 应用层 (Verbs) │

└─────────────────────────────────────────────────────────────┘

│

▼

┌─────────────────────────────────────────────────────────────┐

│ IB 传输层 (L4) │

│ ┌──────────┐ ┌──────────┐ ┌──────────┐ ┌──────────┐ │

│ │ BTH │ │ RETH │ │ AETH │ │ DETH │ │

│ └──────────┘ └──────────┘ └──────────┘ └──────────┘ │

│ - opcode │ - va │ - syndrome│ - q_key │ │

│ - dest_qp │ - rkey │ - msn │ - src_qp │ │

│ - psn │ - length │ │ │ │

│ - ack_req │ │ │ │ │

└─────────────────────────────────────────────────────────────┘

│

▼

┌─────────────────────────────────────────────────────────────┐

│ UDP 层 (L3) │

│ - Source Port: 散列算法计算 (entropy) │

│ - Dest Port: 4791 (RoCEv2 标准端口) │

│ - Checksum: RoCEv2 必须为 0 │

└─────────────────────────────────────────────────────────────┘

│

▼

┌─────────────────────────────────────────────────────────────┐

│ IP 层 (L3) │

│ - IPv4 或 IPv6 │

│ - TTL/Hop Limit │

└─────────────────────────────────────────────────────────────┘

│

▼

┌─────────────────────────────────────────────────────────────┐

│ 以太网层 (L2) │

│ - EtherType: 0x8915 (RoCE) │

│ - MAC 地址 │

└─────────────────────────────────────────────────────────────┘

参考资源

协议规范

| 资源 | 链接 | 说明 |

|---|---|---|

| IB Spec Annex A17 RoCEv2 | https://www.scribd.com/document/350043431/Annex17-RoCEv2 | 官方 RoCEv2 规范 |

| RoCEv2 Protocol 详解 | https://qsysarch.com/posts/the-infiniband-transport-protocol-of-rocev2/ | IB 传输层详解 |

| Nvidia RoCEv2 文档 | https://docs.nvidia.com/networking/display/winofv55053000/rocev2 | 厂商实现文档 |

| Broadcom RoCEv2 CNP | https://docs.broadcom.com/doc/NCC-WP1XX | 拥塞控制说明 |

| Netdev RoCEv2 介绍 | https://netdevconf.org/0x19/docs/netdev-0x19-paper18-talk-slides/netdev-0x19-AI-networking-RoCE-and-netdev.pdf | 协议概览 |

协议头部格式

BTH (Base Transport Header) - 12 bytes

| 字段 | 位数 | 说明 |

|---|---|---|

| Opcode | 8 | 操作码 (Send/Recv/RDMA Write/RDMA Read) |

| Solicited Event | 1 | 是否请求事件 |

| Mig Req | 1 | 迁移请求 |

| Pad Count | 3 | 填充字节数 |

| Transport Version | 3 | 传输版本 |

| P_Key | 16 | 分区密钥 |

| Reserved | 8 | 保留 |

| Dest QP | 24 | 目标队列对编号 |

| Ack Req | 1 | 请求确认 |

| PSN | 24 | 包序列号 |

AETH (Ack Extended Transport Header) - 4 bytes

| 字段 | 位数 | 说明 |

|---|---|---|

| Syndrome | 8 | 0=ACK, 1=NACK, 3=RNR NACK |

| MSN | 24 | 消息序列号 |

RETH (RDMA Extended Transport Header) - 16 bytes)

| 字段 | 位数 | 说明 |

|---|---|---|

| Virtual Address | 64 | 远程虚拟地址 |

| Remote Key | 32 | 远程访问密钥 |

| Length | 32 | 数据长度 |

UDP 封装规则

- 目的端口: 4791 (标准 RoCEv2 端口)

- 源端口:

(SrcPort XOR DstPort) OR 0xC000计算 - 校验和: 必须设置为 0 (RoCEv2 要求)

开源参考实现

| 资源 | 链接 | 说明 |

|---|---|---|

| Alex Forencich UDP/IP Stack | https://github.com/alexforencich/verilog-ethernet | FPGA 实现的以太网栈,包含 RoCEv2 参考 |

| RoCEv2 FPGA Parser | https://www.mdpi.com/2079-9292/13/20/4107 | 学术论文中的 RoCEv2 实现 |

| soft-roce 源码 | https://github.com/SoftRoCE/rxe-rdma-kernel | C 实现的 RDMA 软件模拟 |

实践任务

| 序号 | 任务 | 验收标准 |

|---|---|---|

| 2.1 | 实现 BTH 头部 | 序列化/反序列化正确 |

| 2.2 | 实现 AETH 头部 | ACK/NACK 构造正确 |

| 2.3 | 实现 RETH 头部 | RDMA Read/Write 支持 |

| 2.4 | 实现 UDP 封装 | UDP 端口 4791,校验和为 0 |

| 2.5 | 实现 IP 封装 | IPv4 头部构造正确 |

| 2.6 | 实现以太网帧 | EtherType 0x8915 |

| 2.7 | 完整报文构造 | Wireshark 能解析 |

阶段二检查点

- 理解 RoCEv2 协议栈各层

- 能正确构造 BTH/AETH/RETH 头部

- 能构造完整的 RoCEv2 报文

- Wireshark 能正确识别报文格式

- 实现 UDP 校验和为 0 的规则

阶段三:ibverbs API 实现

目标

实现完整的 RDMA Verbs API,包括 Protection Domain、Memory Region、Completion Queue、Queue Pair 等核心概念。

RDMA 核心概念

┌─────────────────────────────────────────────────────────────────┐

│ RDMA 资源层次结构 │

│ │

│ ┌─────────────────────────────────────────────────────────┐ │

│ │ Context (设备上下文) │ │

│ │ - 代表一个 RDMA 设备 │ │

│ │ - 管理所有资源的生命周期 │ │

│ └─────────────────────────────────────────────────────────┘ │

│ │ │

│ ┌───────────────┼───────────────┐ │

│ ▼ ▼ ▼ │

│ ┌─────────────────┐ ┌───────────────┐ ┌─────────────────┐ │

│ │ Protection │ │ Completion │ │ QP │ │

│ │ Domain (PD) │ │ Queue (CQ) │ │ (Queue Pair) │ │

│ │ │ │ │ │ │ │

│ │ - 内存隔离 │ │ - 异步通知 │ │ - SQ (发送) │ │

│ │ - 访问控制 │ │ - 完成事件 │ │ - RQ (接收) │ │

│ └─────────────────┘ └───────────────┘ └─────────────────┘ │

│ │ │

│ ▼ │

│ ┌─────────────────┐ │

│ │ Memory Region │ │

│ │ (MR) │ │

│ │ │ │

│ │ - lkey (本地) │ │

│ │ - rkey (远程) │ │

│ │ - VA (虚拟地址) │ │

│ │ - Length │ │

│ └─────────────────┘ │

└─────────────────────────────────────────────────────────────────┘

QP 状态机

┌─────────────────────────────────────────────────────────────┐

│ QP 状态机 │

│ │

│ RESET ──────► INIT ──────► RTR ──────► RTS │

│ │ │ │ │ │

│ │ │ │ │ │

│ ▼ ▼ ▼ ▼ │

│ ERROR ERROR ERROR ERROR │

│ │ │

│ ▼ │

│ CLOSING │

│ │ │

│ ▼ │

│ ERROR │

└─────────────────────────────────────────────────────────────┘

状态说明:

- RESET: 初始状态,QP 不可用

- INIT: 已初始化,可以接收 RTR 请求

- RTR (Ready to Receive): 可以接收数据

- RTS (Ready to Send): 可以发送数据

参考资源

Rust ibverbs 库

| 资源 | 链接 | 说明 |

|---|---|---|

| rust-ibverbs | https://github.com/jonhoo/rust-ibverbs | 最流行的 Rust ibverbs 绑定 (197 ⭐) |

| safeverbs | https://github.com/crazyboycjr/safeverbs | 内存安全的 RDMA API (1 ⭐) |

| rdma-rs | https://github.com/phoenix-dataplane/rdma-rs | Rust RDMA 包装器 (2 ⭐) |

| rdma-sys | https://github.com/datenlord/rdma-sys | RDMA FFI 绑定 (49 ⭐) |

| async-rdma | https://github.com/datenlord/async-rdma | 异步 RDMA 框架 (163 ⭐) |

| rdma-cm | https://github.com/akshayknarayan/rdma-cm | RDMA CM 绑定 (1 ⭐) |

ibverbs 官方文档

| 资源 | 链接 | 说明 |

|---|---|---|

| ibverbs crate docs | https://docs.rs/crate/ibverbs/latest | Rust 绑定文档 |

| IB Spec Verbs | https://www.infiniband.org/specs/ | 官方 IB 规范第 11 章 |

| RDMAmojo | https://www.rdmamojo.com/ | RDMA 教程网站 |

核心 API

Protection Domain (PD)

// C API

struct ibv_pd *ibv_alloc_pd(struct ibv_context *context);

int ibv_dealloc_pd(struct ibv_pd *pd);

Memory Region (MR)

// C API

struct ibv_mr *ibv_reg_mr(struct ibv_pd *pd, void *addr, size_t length,

int access);

int ibv_dereg_mr(struct ibv_mr *mr);

Completion Queue (CQ)

// C API

struct ibv_cq *ibv_create_cq(struct ibv_context *context, int cqe,

void *cq_context, struct ibv_comp_channel *channel,

int comp_vector);

int ibv_destroy_cq(struct ibv_cq *cq);

int ibv_poll_cq(struct ibv_cq *cq, int num, struct ibv_wc *wc);

int ibv_req_notify_cq(struct ibv_cq *cq, int solicited_only);

Queue Pair (QP)

// C API

struct ibv_qp *ibv_create_qp(struct ibv_pd *pd, struct ibv_qp_init_attr *attr);

int ibv_destroy_qp(struct ibv_qp *qp);

int ibv_modify_qp(struct ibv_qp *qp, struct ibv_qp_attr *attr,

int attr_mask);

Work Request (WR)

// C API

int ibv_post_send(struct ibv_qp *qp, struct ibv_send_wr *wr,

struct ibv_send_wr **bad_wr);

int ibv_post_recv(struct ibv_qp *qp, struct ibv_recv_wr *wr,

struct ibv_recv_wr **bad_wr);

参考项目结构

erdmaverbs/

├── Cargo.toml

├── src/

│ ├── lib.rs # 库入口

│ ├── context.rs # Device Context

│ ├── pd.rs # Protection Domain

│ ├── mr.rs # Memory Region

│ ├── cq.rs # Completion Queue

│ ├── qp.rs # Queue Pair

│ ├── wr.rs # Work Request

│ ├── wc.rs # Work Completion

│ └── ffi/ # FFI 绑定

│ └── mod.rs

├── build.rs # 绑定生成

└── tests/

└── basic_test.rs

实践任务

| 序号 | 任务 | 验收标准 |

|---|---|---|

| 3.1 | 实现 Context | 能打开/关闭设备 |

| 3.2 | 实现 PD | 能分配/释放保护域 |

| 3.3 | 实现 MR | 能注册内存,返回 lkey/rkey |

| 3.4 | 实现 CQ | 能创建/销毁完成队列 |

| 3.5 | 实现 QP | 能创建 QP,实现状态机转换 |

| 3.6 | 实现 WR | 能发送 Send/Recv WR |

| 3.7 | 实现 WC | 能 poll 到正确的完成事件 |

阶段三检查点

- 理解 RDMA 核心概念 (PD/MR/CQ/QP)

- 能实现完整的 Verbs API

- QP 状态机转换正确

- 内存注册返回正确的 lkey/rkey

- 完成事件能正确通知应用

附录

技术栈总结

| 层级 | 技术/工具 | 用途 |

|---|---|---|

| I/O | io-uring / tokio-uring | 高性能异步 I/O |

| 网络 | UDP Socket | RoCEv2 报文收发 |

| FFI | bindgen | C 库绑定生成 |

| 协议 | 手写 RoCEv2 | IB over UDP |

| 测试 | Wireshark | 报文分析 |

推荐学习路径

第 1-2 周: io_uring 基础

│

├── 官方文档阅读

├── 编译运行示例代码

└── 实现 UDP echo server

│

└── 阶段一检查点 ✓

第 3-5 周: RoCEv2 协议

│

├── 阅读 IB Spec RoCEv2 章节

├── 实现 BTH/AETH/RETH 头部

├── 构造完整报文

└── Wireshark 验证

│

└── 阶段二检查点 ✓

第 6-10 周: ibverbs API

│

├── 阅读 rust-ibverbs 源码

├── 实现 PD/MR/CQ

├── 实现 QP 状态机

├── 实现 WR/WC

└── 集成测试

│

└── 阶段三检查点 ✓

参考资料汇总

io_uring

- https://docs.rs/io-uring/latest/io_uring/

- https://docs.rs/tokio-uring/latest/tokio_uring/

- https://github.com/espoal/uring_examples

- https://unixism.net/2020/04/io-uring-by-example-1-introduction-to-io_uring/

RoCEv2 协议

- https://www.scribd.com/document/350043431/Annex17-RoCEv2

- https://qsysarch.com/posts/the-infiniband-transport-protocol-of-rocev2/

- https://docs.nvidia.com/networking/display/winofv55053000/rocev2

- https://github.com/alexforencich/verilog-ethernet

ibverbs

- https://github.com/jonhoo/rust-ibverbs

- https://docs.rs/crate/ibverbs/latest

- https://www.rdmamojo.com/

- https://github.com/datenlord/async-rdma

环境安装

# 安装编译依赖

sudo apt install -y \

build-essential \

libclang-dev \

libnuma-dev \

librdmacm-dev \

libibverbs-dev \

liburing-dev

# 安装 Rust

curl --proto '=https' --tlsv1.2 -sSf https://sh.rustup.rs | sh -s -- -y

# 验证安装

cargo --version

rustc --version

方案二:Rust 内核模块实现 (待研究)

启动条件

- io_uring 方案完成基础功能后

- 或有充足时间 (6+ 个月)

- 或有明确的学术研究目标

参考项目

待研究内容

- Rust 内核编程约束

- 内存安全与内核兼容性

- 调试与错误排查

RDMA libibverbs 初始化与数据路径指南

*** 这个是AI 生成的参考文档,不一定正确!!! ***

📖 目录

RDMA 初始化流程

初始化步骤概览

┌─────────────────────────────────────────────────────────────┐

│ RDMA 初始化流程 │

└─────────────────────────────────────────────────────────────┘

Step 1: 获取 RDMA 设备

↓

Step 2: 打开设备并获取上下文

↓

Step 3: 查询设备属性

↓

Step 4: 分配保护域(PD)

↓

Step 5: 创建完成队列(CQ)

↓

Step 6: 创建队列对(QP)

↓

Step 7: 注册内存区域(MR)

↓

Step 8: 建立连接(可选)

↓

✅ 初始化完成,可以开始数据传输

详细初始化步骤

Step 1: 获取 RDMA 设备列表

┌──────────────────────────────────┐

│ ibv_get_device_list() │

│ 获取系统中所有 RDMA 设备 │

└──────────────────────────────────┘

↓

返回设备列表

├─ device[0]: mlx5_0

├─ device[1]: mlx5_1

└─ device[2]: NULL (列表结束)

关键信息:

- 返回

struct ibv_device **指针数组 - 最后一个元素为 NULL

- 需要手动释放:

ibv_free_device_list()

Step 2: 打开设备并获取上下文

┌──────────────────────────────────────────┐

│ ibv_open_device(device) │

│ 打开选定的 RDMA 设备 │

└──────────────────────────────────────────┘

↓

返回设备上下文

├─ struct ibv_context

├─ 包含设备信息

└─ 用于后续操作

关键信息:

- 返回

struct ibv_context * - 包含设备的所有信息

- 需要手动释放:

ibv_close_device()

Step 3: 查询设备属性

┌──────────────────────────────────────────┐

│ ibv_query_device(context, &attr) │

│ 获取设备的详细属性 │

└──────────────────────────────────────────┘

↓

返回设备属性

├─ max_qp: 最大队列对数

├─ max_cq: 最大完成队列数

├─ max_mr: 最大内存区域数

├─ max_qp_wr: 队列对最大工作请求

├─ max_sge: 最大分散聚集元素

├─ max_mr_size: 最大内存注册大小

└─ hw_ver: 硬件版本

关键信息:

- 了解硬件能力

- 用于资源规划

- 返回

struct ibv_device_attr

Step 4: 分配保护域(Protection Domain)

┌──────────────────────────────────────────┐

│ ibv_alloc_pd(context) │

│ 为设备分配保护域 │

└──────────────────────────────────────────┘

↓

返回保护域

├─ struct ibv_pd

├─ 用于内存注册

├─ 用于队列对创建

└─ 用于完成队列创建

关键信息:

- PD 是内存和队列对的容器

- 同一 PD 内的资源可以相互访问

- 需要手动释放:

ibv_dealloc_pd()

Step 5: 创建完成队列(Completion Queue)

┌──────────────────────────────────────────┐

│ ibv_create_cq(context, cqe, NULL, NULL) │

│ 创建完成队列 │

└──────────────────────────────────────────┘

↓

返回完成队列

├─ struct ibv_cq

├─ cqe: 完成队列元素数

├─ 用于接收完成事件

└─ 用于轮询完成状态

关键信息:

- CQ 用于接收操作完成通知

- 可以为 Send CQ 和 Recv CQ 创建不同的队列

- 也可以共用一个 CQ

Step 6: 创建队列对(Queue Pair)

┌──────────────────────────────────────────────────────┐

│ ibv_create_qp(pd, &qp_init_attr) │

│ 创建队列对(RDMA 通信的核心) │

└──────────────────────────────────────────────────────┘

↓

返回队列对

├─ struct ibv_qp

├─ qp_num: 队列对号

├─ send_cq: Send 完成队列

├─ recv_cq: Recv 完成队列

├─ sq_psn: Send 包序列号

├─ rq_psn: Recv 包序列号

└─ qp_state: 初始状态 (RESET)

关键信息:

- QP 是 RDMA 通信的基本单位

- 需要配置

struct ibv_qp_init_attr - 初始状态为 RESET

- 需要手动释放:

ibv_destroy_qp()

QP 初始化属性:

struct ibv_qp_init_attr {

void *qp_context; // 用户定义的上下文

struct ibv_cq *send_cq; // Send 完成队列

struct ibv_cq *recv_cq; // Recv 完成队列

struct ibv_srq *srq; // 共享接收队列(可选)

struct ibv_qp_cap cap; // 队列对能力

enum ibv_qp_type qp_type; // 队列对类型(IBV_QPT_RC/UC/UD)

int sq_sig_all; // 是否所有 Send 都生成完成事件

};

Step 7: 注册内存区域(Memory Region)

┌──────────────────────────────────────────┐

│ ibv_reg_mr(pd, buf, size, access) │

│ 注册用于 RDMA 的内存区域 │

└──────────────────────────────────────────┘

↓

返回内存区域

├─ struct ibv_mr

├─ addr: 内存地址

├─ length: 内存大小

├─ lkey: 本地密钥(用于 Send/Recv)

├─ rkey: 远程密钥(用于 RDMA Write/Read)

└─ 用于数据传输

关键信息:

- 必须注册所有用于 RDMA 的内存

- 注册会锁定内存(防止 swap)

- lkey 用于本地操作

- rkey 用于远程操作

- 需要手动释放:

ibv_dereg_mr()

访问权限:

enum ibv_access_flags {

IBV_ACCESS_LOCAL_WRITE = 1, // 本地写

IBV_ACCESS_REMOTE_WRITE = (1 << 1), // 远程写

IBV_ACCESS_REMOTE_READ = (1 << 2), // 远程读

IBV_ACCESS_REMOTE_ATOMIC = (1 << 3), // 远程原子操作

IBV_ACCESS_MW_BIND = (1 << 4), // 内存窗口绑定

};

Step 8: 建立连接(可选)

┌──────────────────────────────────────────┐

│ 修改 QP 状态 │

│ RESET → INIT → RTR → RTS │

└──────────────────────────────────────────┘

↓

┌─────────────────────────────────┐

│ RESET (初始状态) │

│ ↓ ibv_modify_qp() │

│ INIT (初始化) │

│ ↓ ibv_modify_qp() │

│ RTR (Ready to Receive) │

│ ↓ ibv_modify_qp() │

│ RTS (Ready to Send) │

│ ✅ 可以发送和接收数据 │

└─────────────────────────────────┘

QP 状态转换:

// RESET → INIT

struct ibv_qp_attr attr = {

.qp_state = IBV_QPS_INIT,

.pkey_index = 0,

.port_num = 1,

.qp_access_flags = IBV_ACCESS_REMOTE_WRITE | IBV_ACCESS_REMOTE_READ,

};

ibv_modify_qp(qp, &attr, IBV_QP_STATE | IBV_QP_PKEY_INDEX |

IBV_QP_PORT | IBV_QP_ACCESS_FLAGS);

// INIT → RTR

attr.qp_state = IBV_QPS_RTR;

attr.path_mtu = IBV_MTU_1024;

attr.dest_qp_num = remote_qp_num;

attr.rq_psn = remote_psn;

// ... 设置其他属性

ibv_modify_qp(qp, &attr, ...);

// RTR → RTS

attr.qp_state = IBV_QPS_RTS;

attr.sq_psn = local_psn;

attr.timeout = 14;

attr.retry_cnt = 7;

attr.rnr_retry = 7;

ibv_modify_qp(qp, &attr, ...);

数据路径(DP)流程

数据路径概览

┌─────────────────────────────────────────────────────────────┐

│ RDMA 数据路径流程 │

└─────────────────────────────────────────────────────────────┘

应用程序

↓

┌──────────────────────────────────────────┐

│ 1. 准备工作请求(Work Request) │

│ - Send WR / Recv WR │

│ - 设置数据缓冲区和长度 │

└──────────────────────────────────────────┘

↓

┌──────────────────────────────────────────┐

│ 2. 提交工作请求到队列对 │

│ - ibv_post_send() / ibv_post_recv() │

│ - 请求进入 SQ / RQ │

└──────────────────────────────────────────┘

↓

┌──────────────────────────────────────────┐

│ 3. 网卡处理请求 │

│ - 从队列中取出请求 │

│ - 执行 RDMA 操作 │

│ - 生成完成事件 │

└──────────────────────────────────────────┘

↓

┌──────────────────────────────────────────┐

│ 4. 轮询或等待完成事件 │

│ - ibv_poll_cq() / ibv_get_cq_event() │

│ - 获取完成状态 │

└──────────────────────────────────────────┘

↓

┌──────────────────────────────────────────┐

│ 5. 处理完成事件 │

│ - 检查操作状态 │

│ - 处理数据 │

│ - 继续下一个操作 │

└──────────────────────────────────────────┘

详细数据路径步骤

Step 1: 准备工作请求(Work Request)

┌─────────────────────────────────────────────────┐

│ struct ibv_send_wr / struct ibv_recv_wr │

│ 定义要执行的 RDMA 操作 │

└─────────────────────────────────────────────────┘

Send Work Request 结构:

┌──────────────────────────────────────────┐

│ struct ibv_send_wr { │

│ uint64_t wr_id; // 工作请求ID │

│ struct ibv_send_wr *next; // 链表指针 │

│ struct ibv_sge *sg_list; // 分散聚集 │

│ int num_sge; // SGE 数量 │

│ enum ibv_wr_opcode opcode; // 操作类型 │

│ int send_flags; // 发送标志 │

│ union { │

│ struct { │

│ uint32_t remote_qpn; // 远程 QPN │

│ uint32_t remote_qkey; // 远程 QKEY │

│ } ud; │

│ struct { │

│ uint64_t remote_addr; // 远程地址 │

│ uint32_t rkey; // 远程密钥 │

│ } rdma; │

│ }; │

│ }; │

└──────────────────────────────────────────┘

Recv Work Request 结构:

┌──────────────────────────────────────────┐

│ struct ibv_recv_wr { │

│ uint64_t wr_id; // 工作请求ID │

│ struct ibv_recv_wr *next; // 链表指针 │

│ struct ibv_sge *sg_list; // 分散聚集 │

│ int num_sge; // SGE 数量 │

│ }; │

└──────────────────────────────────────────┘

分散聚集元素(SGE):

┌──────────────────────────────────────────┐

│ struct ibv_sge { │

│ uint64_t addr; // 内存地址 │

│ uint32_t length; // 数据长度 │

│ uint32_t lkey; // 本地密钥 │

│ }; │

└──────────────────────────────────────────┘

操作类型(opcode):

enum ibv_wr_opcode {

IBV_WR_SEND, // Send 操作

IBV_WR_SEND_WITH_IMM, // Send with Immediate

IBV_WR_RDMA_WRITE, // RDMA Write

IBV_WR_RDMA_WRITE_WITH_IMM, // RDMA Write with Immediate

IBV_WR_RDMA_READ, // RDMA Read

IBV_WR_ATOMIC_CMP_AND_SWP, // 原子比较交换

IBV_WR_ATOMIC_FETCH_AND_ADD, // 原子加

IBV_WR_LOCAL_INV, // 本地失效

IBV_WR_BIND_MW, // 绑定内存窗口

IBV_WR_SEND_WITH_INV, // Send with Invalidate

};

Step 2: 提交工作请求到队列对

┌─────────────────────────────────────────────────┐

│ ibv_post_send(qp, &wr, &bad_wr) │

│ 或 │

│ ibv_post_recv(qp, &wr, &bad_wr) │

│ 提交工作请求到队列对 │

└─────────────────────────────────────────────────┘

应用程序

↓

┌──────────────────────────────────────┐

│ 工作请求链表 │

│ wr1 → wr2 → wr3 → NULL │

└──────────────────────────────────────┘

↓

┌──────────────────────────────────────┐

│ ibv_post_send() / ibv_post_recv() │

│ 验证请求 │

│ 检查队列空间 │

│ 提交到硬件队列 │

└──────────────────────────────────────┘

↓

┌──────────────────────────────────────┐

│ 队列对(QP) │

│ ┌──────────────────────────────────┐ │

│ │ Send Queue (SQ) │ │

│ │ [WR1] [WR2] [WR3] [ ] [ ] │ │

│ └──────────────────────────────────┘ │

│ ┌──────────────────────────────────┐ │

│ │ Recv Queue (RQ) │ │

│ │ [WR1] [WR2] [ ] [ ] [ ] │ │

│ └──────────────────────────────────┘ │

└──────────────────────────────────────┘

关键信息:

- 可以一次提交多个 WR(链表形式)

- 如果失败,

bad_wr指向第一个失败的 WR - 返回值:0 表示成功,-1 表示失败

Step 3: 网卡处理请求

┌─────────────────────────────────────────────────┐

│ 网卡硬件处理 │

└─────────────────────────────────────────────────┘

┌──────────────────────────────────────────────────┐

│ 网卡处理流程 │

├──────────────────────────────────────────────────┤

│ │

│ 1. 从 SQ 取出工作请求 │

│ ↓ │

│ 2. 解析请求参数 │

│ - 操作类型(Send/RDMA Write/Read) │

│ - 数据地址和长度 │

│ - 远程地址和密钥(如果是 RDMA 操作) │

│ ↓ │

│ 3. 执行 RDMA 操作 │

│ ├─ Send: 发送数据到远程 QP │

│ ├─ RDMA Write: 写数据到远程内存 │

│ ├─ RDMA Read: 从远程内存读数据 │

│ └─ Atomic: 执行原子操作 │

│ ↓ │

│ 4. 生成完成事件 │

│ - 写入完成队列(CQ) │

│ - 触发中断(如果启用) │

│ ↓ │

│ 5. 更新队列指针 │

│ - 从 SQ 中移除已处理的 WR │

│ ↓ │

│ ✅ 操作完成 │

│ │

└──────────────────────────────────────────────────┘

RDMA 操作类型:

Send 操作:

┌─────────────┐ ┌─────────────┐

│ 发送端 QP │ ──────→ │ 接收端 QP │

│ Send WR │ 网络 │ Recv WR │

└─────────────┘ └─────────────┘

数据进入 RQ,触发完成事件

RDMA Write 操作(One-Sided):

┌─────────────┐ ┌─────────────┐

│ 发送端 QP │ ──────→ │ 远程内存 │

│ RDMA Write │ 网络 │ (无需 QP) │

└─────────────┘ └─────────────┘

直接写入远程内存,无需远程 CPU 参与

RDMA Read 操作(One-Sided):

┌─────────────┐ ┌─────────────┐

│ 发送端 QP │ ←────── │ 远程内存 │

│ RDMA Read │ 网络 │ (无需 QP) │

└─────────────┘ └─────────────┘

直接从远程内存读取数据,无需远程 CPU 参与

Step 4: 轮询或等待完成事件

┌─────────────────────────────────────────────────┐

│ ibv_poll_cq(cq, num_entries, wc) │

│ 或 │

│ ibv_get_cq_event(channel, &cq, &cq_context) │

│ 获取完成事件 │

└─────────────────────────────────────────────────┘

完成队列(CQ)结构:

┌──────────────────────────────────────────┐

│ struct ibv_cq { │

│ struct ibv_context *context; │

│ struct ibv_comp_channel *channel; │

│ void *cq_context; │

│ uint32_t handle; │

│ int cqe; │

│ }; │

└──────────────────────────────────────────┘

完成工作条目(WC)结构:

┌──────────────────────────────────────────┐

│ struct ibv_wc { │

│ uint64_t wr_id; // 工作请求 ID │

│ enum ibv_wc_status status; // 完成状态 │

│ enum ibv_wc_opcode opcode; // 操作类型 │

│ uint32_t vendor_err; // 厂商错误码 │

│ uint32_t byte_len; // 传输字节数 │

│ uint32_t imm_data; // Immediate 数据│

│ uint32_t qp_num; // 队列对号 │

│ uint32_t src_qp; // 源 QP 号 │

│ int wc_flags; // 完成标志 │

│ uint16_t pkey_index; // 分区键索引 │

│ uint16_t slid; // 源 LID │

│ uint8_t sl; // 服务级别 │

│ uint8_t dlid_path_bits; // DLID 路径位 │

│ }; │

└──────────────────────────────────────────┘

轮询方式(Polling):

┌──────────────────────────────────────────┐

│ while (1) { │

│ int ne = ibv_poll_cq(cq, 10, wc); │

│ if (ne > 0) { │

│ for (int i = 0; i < ne; i++) { │

│ // 处理完成事件 │

│ if (wc[i].status != IBV_WC_SUCCESS)│

│ // 错误处理 │

│ } │

│ } │

│ } │

└──────────────────────────────────────────┘

事件驱动方式(Event-Driven):

┌──────────────────────────────────────────┐

│ // 请求完成事件通知 │

│ ibv_req_notify_cq(cq, 0); │

│ │

│ // 等待事件 │

│ struct ibv_cq *ev_cq; │

│ void *ev_ctx; │

│ ibv_get_cq_event(channel, &ev_cq, │

│ &ev_ctx); │

│ │

│ // 确认事件 │

│ ibv_ack_cq_events(cq, 1); │

│ │

│ // 轮询获取完成条目 │

│ int ne = ibv_poll_cq(cq, 10, wc); │

└──────────────────────────────────────────┘

完成状态(status):

enum ibv_wc_status {

IBV_WC_SUCCESS, // 成功

IBV_WC_LOC_LEN_ERR, // 本地长度错误

IBV_WC_LOC_QP_OP_ERR, // 本地 QP 操作错误

IBV_WC_LOC_EEC_OP_ERR, // 本地 EEC 操作错误

IBV_WC_LOC_PROT_ERR, // 本地保护错误

IBV_WC_WR_FLUSH_ERR, // 工作请求刷新错误

IBV_WC_MW_BIND_ERR, // 内存窗口绑定错误

IBV_WC_BAD_RESP_ERR, // 坏响应错误

IBV_WC_LOC_ACCESS_ERR, // 本地访问错误

IBV_WC_REM_INV_REQ_ERR, // 远程无效请求错误

IBV_WC_REM_ACCESS_ERR, // 远程访问错误

IBV_WC_REM_OP_ERR, // 远程操作错误

IBV_WC_RETRY_EXC_ERR, // 重试超限错误

IBV_WC_RNR_RETRY_EXC_ERR, // RNR 重试超限错误

IBV_WC_LOC_RDD_VIOL_ERR, // 本地 RDD 违规错误

IBV_WC_REM_INVALID_RD_REQ_ERR, // 远程无效 RD 请求错误

IBV_WC_REM_ABORT_ERR, // 远程中止错误

IBV_WC_INV_EECN_ERR, // 无效 EECN 错误

IBV_WC_INV_EEC_STATE_ERR, // 无效 EEC 状态错误

IBV_WC_FATAL_ERR, // 致命错误

IBV_WC_RESP_TIMEOUT_ERR, // 响应超时错误

IBV_WC_GENERAL_ERR, // 通用错误

};

Step 5: 处理完成事件

┌─────────────────────────────────────────────────┐

│ 处理完成工作条目(WC) │

└─────────────────────────────────────────────────┘

┌──────────────────────────────────────────────────┐

│ 完成事件处理流程 │

├──────────────────────────────────────────────────┤

│ │

│ 1. 检查完成状态 │

│ if (wc.status != IBV_WC_SUCCESS) { │

│ // 错误处理 │

│ fprintf(stderr, "Error: %s\n", │

│ ibv_wc_status_str(wc.status)); │

│ return -1; │

│ } │

│ ↓ │

│ 2. 根据操作类型处理 │

│ switch (wc.opcode) { │

│ case IBV_WC_SEND: │

│ // Send 操作完成 │

│ printf("Send completed\n"); │

│ break; │

│ case IBV_WC_RECV: │

│ // Recv 操作完成 │

│ printf("Received %d bytes\n", │

│ wc.byte_len); │

│ break; │

│ case IBV_WC_RDMA_WRITE: │

│ // RDMA Write 完成 │

│ printf("RDMA Write completed\n"); │

│ break; │

│ case IBV_WC_RDMA_READ: │

│ // RDMA Read 完成 │

│ printf("RDMA Read completed\n"); │

│ break; │

│ } │

│ ↓ │

│ 3. 处理数据 │

│ // 根据 wr_id 找到对应的数据缓冲区 │

│ struct buffer *buf = find_buffer(wc.wr_id); │

│ process_data(buf, wc.byte_len); │

│ ↓ │

│ 4. 继续下一个操作 │

│ // 如果需要,提交新的工作请求 │

│ submit_next_wr(qp); │

│ ↓ │

│ ✅ 处理完成 │

│ │

└──────────────────────────────────────────────────┘

代码示例

完整的初始化示例

#include <infiniband/verbs.h>

#include <stdio.h>

#include <stdlib.h>

#include <string.h>

int main() {

// Step 1: 获取设备列表

int num_devices;

struct ibv_device **dev_list = ibv_get_device_list(&num_devices);

if (!dev_list) {

fprintf(stderr, "Failed to get device list\n");

return -1;

}

printf("Found %d RDMA devices\n", num_devices);

// Step 2: 打开第一个设备

struct ibv_context *context = ibv_open_device(dev_list[0]);

if (!context) {

fprintf(stderr, "Failed to open device\n");

ibv_free_device_list(dev_list);

return -1;

}

printf("Device opened successfully\n");

// Step 3: 查询设备属性

struct ibv_device_attr device_attr;

if (ibv_query_device(context, &device_attr)) {

fprintf(stderr, "Failed to query device\n");

ibv_close_device(context);

ibv_free_device_list(dev_list);

return -1;

}

printf("Max QP: %d, Max CQ: %d, Max MR: %d\n",

device_attr.max_qp, device_attr.max_cq, device_attr.max_mr);

// Step 4: 分配保护域

struct ibv_pd *pd = ibv_alloc_pd(context);

if (!pd) {

fprintf(stderr, "Failed to allocate PD\n");

ibv_close_device(context);

ibv_free_device_list(dev_list);

return -1;

}

printf("PD allocated successfully\n");

// Step 5: 创建完成队列

struct ibv_cq *cq = ibv_create_cq(context, 100, NULL, NULL, 0);

if (!cq) {

fprintf(stderr, "Failed to create CQ\n");

ibv_dealloc_pd(pd);

ibv_close_device(context);

ibv_free_device_list(dev_list);

return -1;

}

printf("CQ created successfully\n");

// Step 6: 创建队列对

struct ibv_qp_init_attr qp_init_attr = {

.qp_context = NULL,

.send_cq = cq,

.recv_cq = cq,

.srq = NULL,

.cap = {

.max_send_wr = 100,

.max_recv_wr = 100,

.max_send_sge = 1,

.max_recv_sge = 1,

.max_inline_data = 0,

},

.qp_type = IBV_QPT_RC,

.sq_sig_all = 0,

};

struct ibv_qp *qp = ibv_create_qp(pd, &qp_init_attr);

if (!qp) {

fprintf(stderr, "Failed to create QP\n");

ibv_destroy_cq(cq);

ibv_dealloc_pd(pd);

ibv_close_device(context);

ibv_free_device_list(dev_list);

return -1;

}

printf("QP created successfully (QP number: %d)\n", qp->qp_num);

// Step 7: 注册内存区域

char *buf = malloc(4096);

struct ibv_mr *mr = ibv_reg_mr(pd, buf, 4096,

IBV_ACCESS_LOCAL_WRITE |

IBV_ACCESS_REMOTE_WRITE |

IBV_ACCESS_REMOTE_READ);

if (!mr) {

fprintf(stderr, "Failed to register MR\n");

free(buf);

ibv_destroy_qp(qp);

ibv_destroy_cq(cq);

ibv_dealloc_pd(pd);

ibv_close_device(context);

ibv_free_device_list(dev_list);

return -1;

}

printf("MR registered successfully (lkey: %d, rkey: %d)\n",

mr->lkey, mr->rkey);

// 清理资源

ibv_dereg_mr(mr);

free(buf);

ibv_destroy_qp(qp);

ibv_destroy_cq(cq);

ibv_dealloc_pd(pd);

ibv_close_device(context);

ibv_free_device_list(dev_list);

printf("Initialization completed successfully!\n");

return 0;

}

数据路径示例

// Send 操作

struct ibv_sge sge = {

.addr = (uintptr_t)buf,

.length = 256,

.lkey = mr->lkey,

};

struct ibv_send_wr send_wr = {

.wr_id = 1,

.next = NULL,

.sg_list = &sge,

.num_sge = 1,

.opcode = IBV_WR_SEND,

.send_flags = IBV_SEND_SIGNALED,

};

struct ibv_send_wr *bad_wr;

if (ibv_post_send(qp, &send_wr, &bad_wr)) {

fprintf(stderr, "Failed to post send\n");

return -1;

}

// 轮询完成事件

struct ibv_wc wc;

int ne = ibv_poll_cq(cq, 1, &wc);

if (ne > 0) {

if (wc.status == IBV_WC_SUCCESS) {

printf("Send completed successfully\n");

} else {

printf("Send failed: %s\n", ibv_wc_status_str(wc.status));

}

}

常见问题

Q1: PD、CQ、QP 之间的关系是什么?

PD (保护域)

├─ 用于内存注册

├─ 用于创建 QP

└─ 同一 PD 内的资源可以相互访问

CQ (完成队列)

├─ 接收 Send 操作的完成事件

├─ 接收 Recv 操作的完成事件

└─ 可以为 Send 和 Recv 使用不同的 CQ

QP (队列对)

├─ 属于某个 PD

├─ 使用某个 CQ(或多个 CQ)

└─ 是 RDMA 通信的基本单位

Q2: lkey 和 rkey 有什么区别?

- lkey:本地密钥,用于本地操作(Send/Recv)

- rkey:远程密钥,用于远程操作(RDMA Write/Read)

Q3: 为什么需要注册内存?

- 锁定内存,防止被 swap 到磁盘

- 获取 lkey 和 rkey,用于 RDMA 操作

- 网卡需要知道内存的物理地址

Q4: QP 状态转换的顺序是什么?

RESET → INIT → RTR → RTS

- RESET:初始状态

- INIT:初始化状态

- RTR:Ready to Receive,可以接收数据

- RTS:Ready to Send,可以发送数据

Q5: Send 和 RDMA Write 有什么区别?

Send:

- 两端都需要 QP

- 接收端需要提前 post recv

- 数据进入接收端的 RQ

- 需要接收端的 CPU 参与

RDMA Write:

- 只需要发送端的 QP

- 接收端不需要参与

- 直接写入远程内存

- 接收端的 CPU 不需要参与

总结

初始化流程(8 步)

- 获取设备列表

- 打开设备

- 查询设备属性

- 分配保护域

- 创建完成队列

- 创建队列对

- 注册内存区域

- 建立连接(修改 QP 状态)

数据路径流程(5 步)

- 准备工作请求

- 提交工作请求

- 网卡处理请求

- 轮询或等待完成事件

- 处理完成事件

更多资源:

dpdk

DPDK 专栏,基于 官方 http://doc.dpdk.org/guides/prog_guide/ 的 program guide,从代码中验证相关实现细节。

官方文档中的每一个章节,会有相应的技术实现细节。

章节目录(Draft)

- 00:专栏导读与阅读方法

- 01:EAL 初始化与 lcore/线程模型

- 02:Hugepage/内存子系统

- 03:mempool 机制

- 04:mbuf 与 pktmbuf 分配路径

- 05:ring / rte_ring

- 06:ethdev 抽象

- 07:PMD 驱动加载与探测

- 08:RX/TX 数据通路

- 09:multi-process 与 IPC

- 10:service cores 与调度

- 11:telemetry / stats / debug

- 12:flow/ACL 规则下发

- 13:vhost-user / virtio-user

- 14:性能调优方法论

实现进度(手工维护)

状态枚举:

- 未开始:仅有章节骨架

- 进行中:正在阅读源码/补图/补验证

- 已完成:主流程 + 关键数据结构 + 可复现验证已补齐

- 待重构:内容需要重写/拆分/补证据链

| 章节 | 状态 | 里程碑/完成度 | 备注(代码阅读路径/关键点) | 最后更新 |

|---|---|---|---|---|

| 00:专栏导读与阅读方法 | 已完成 | 100% | 建立 Program Guide ↔ /home/panda/dpdk 源码映射与写作模板 | 2026-03-16 |

| 01:EAL 初始化与 lcore/线程模型 | 已完成 | 100% | lib/eal/linux/eal.c:rte_eal_init()、IOVA 选择、bus scan | 2026-03-16 |

| 02:Hugepage/内存子系统 | 已完成 | 100% | lib/eal/common/eal_common_memory.c:memseg_list/virt↔iova | 2026-03-16 |

| 03:mempool 机制 | 已完成 | 100% | lib/mempool/rte_mempool.c:ops 选择、per-lcore cache、cookies | 2026-03-16 |

| 04:mbuf 与 pktmbuf 分配路径 | 已完成 | 100% | lib/mbuf/rte_mbuf.c:pool_create/extbuf/sanity check | 2026-03-16 |

| 05:ring / rte_ring | 已完成 | 100% | lib/ring/rte_ring_core.h + lib/ring/rte_ring.c:head/tail、flags | 2026-03-16 |

| 06:ethdev 抽象 | 已完成 | 100% | lib/ethdev/rte_ethdev.c:rte_eth_devices[]、rte_eth_fp_ops[] | 2026-03-16 |

| 07:PMD 驱动加载与探测 | 已完成 | 100% | lib/eal/common/eal_common_bus.c + drivers/bus/pci/* | 2026-03-16 |

| 08:RX/TX 数据通路 | 已完成 | 100% | ethdev fp_ops → PMD rx_burst/tx_burst;offload 传递链路 | 2026-03-16 |

| 09:multi-process 与 IPC | 已完成 | 100% | lib/eal/common/eal_common_proc.c:UDS + SCM_RIGHTS + mp-msg thread | 2026-03-16 |

| 10:service cores 与调度 | 已完成 | 100% | lib/eal/common/rte_service.c:register/runstate/stats;示例 examples/service_cores | 2026-03-16 |

| 11:telemetry / stats / debug | 已完成 | 100% | lib/telemetry/*、lib/metrics/*telemetry*、ethdev stats/xstats | 2026-03-16 |

| 12:flow/ACL 规则下发 | 已完成 | 100% | lib/ethdev/rte_flow.c/h + examples/flow_filtering + PMD flow 实现 | 2026-03-16 |

| 13:vhost-user / virtio-user | 已完成 | 100% | lib/vhost/*:register、协议处理、vring 数据面;示例 examples/vhost | 2026-03-16 |

| 14:性能调优方法论 | 已完成 | 100% | pinning/NUMA → mempool/ring/mbuf → queue/RSS → offload → profiling | 2026-03-16 |

lpm算法

网上对于 DPDK LPM 算法的描述都有点不清不楚的,还不如官方的描述。

我这里就结合官方的 文档,然后结合我自己的理解把优劣都说一下。

原理

LPM(Longest Prefix Match,最长前缀匹配)是 IP 路由转发中的核心算法。对于一个目的 IP 地址,需要在路由表中找到与之匹配的、前缀最长的那条路由规则,并返回其 next hop。

DPDK 的 LPM 实现采用了 DIR-24-8 算法的变体,核心思路是:用空间换时间,通过预展开(prefix expansion)将查找操作压缩到 1~2 次内存访问。

基本数据结构

整个 LPM 实例由三层数据结构组成:

┌─────────────────────────────────────────────────────────────────┐

│ struct __rte_lpm │

│ │

│ ┌──────────────────────────────────────────────────────────┐ │

│ │ struct rte_lpm │ │

│ │ tbl24[2^24] ──────────────────────────────────────► │ │

│ │ *tbl8 ──────────────────────────────────────► │ │

│ └──────────────────────────────────────────────────────────┘ │

│ │

│ name[32] │

│ max_rules │

│ number_tbl8s │

│ rule_info[32] (每个 depth 一个 rte_lpm_rule_info) │

│ *rules_tbl (高层规则表,用于增删查) │

│ *v / rcu_mode / *dq (RCU 相关) │

└─────────────────────────────────────────────────────────────────┘

1. tbl24 —— 第一级查找表

// rte_lpm.h

#define RTE_LPM_TBL24_NUM_ENTRIES (1 << 24) // 16,777,216 个条目

struct rte_lpm_tbl_entry {

uint32_t next_hop :24; // next hop 或 tbl8 的 group 索引

uint32_t valid :1; // 该条目是否有效

uint32_t valid_group :1; // 0: 直接存 next_hop; 1: 指向 tbl8

uint32_t depth :6; // 匹配的规则深度(前缀长度)

};

每个条目 4 字节,整张表共 64 MB。以 IP 地址的高 24 位作为索引。

valid_group 字段是关键标志:

valid_group == 0:该条目直接存储 next hop,查找在此结束valid_group == 1:该条目存储的是 tbl8 的 group 索引,需要继续查 tbl8

2. tbl8 —— 第二级查找表

// rte_lpm.h

#define RTE_LPM_TBL8_GROUP_NUM_ENTRIES 256 // 每个 group 256 个条目

#define RTE_LPM_TBL8_NUM_GROUPS 256 // 默认 256 个 group(可配置)

tbl8 由若干个 group 组成,每个 group 有 256 个 rte_lpm_tbl_entry,以 IP 地址的低 8 位作为索引。

对于 tbl8 中的条目,valid_group 字段含义变为:当前 tbl8 group 是否正在使用(而非指向下一级)。

3. rules_tbl —— 高层规则表

// rte_lpm.c (内部结构)

struct rte_lpm_rule {

uint32_t ip; // 规则的 IP 地址(已按 depth 做掩码)

uint32_t next_hop; // 下一跳

};

struct rte_lpm_rule_info {

uint32_t used_rules; // 该 depth 已使用的规则数

uint32_t first_rule; // 该 depth 规则在 rules_tbl 中的起始索引

};

rules_tbl 是一个平坦数组,按 depth 分组存储所有规则。rule_info[32] 数组记录每个 depth(1~32)的规则起始位置和数量。

这张表不参与数据面查找,仅用于控制面的增删操作(检查规则是否存在、删除时寻找替代规则等)。

整体结构关系图

graph TD

subgraph "__rte_lpm(控制面 + 数据面)"

A["rules_tbl[]<br/>高层规则表<br/>按 depth 分组"]

B["rule_info[32]<br/>每个 depth 的<br/>起始位置和数量"]

C["tbl24[2^24]<br/>第一级查找表<br/>以 IP[31:8] 为索引"]

D["tbl8[N × 256]<br/>第二级查找表<br/>以 IP[7:0] 为索引"]

end

B -->|"记录偏移"| A

C -->|"valid_group=1 时<br/>group_idx 指向"| D

C -->|"valid_group=0 时<br/>直接返回 next_hop"| E["next_hop"]

D -->|"valid=1 时<br/>返回 next_hop"| E

tbl_entry 字段布局(小端)

31 8 7 6 5 1 0

┌──────────┬───────┬──────────┬───────┐

│ next_hop │ depth │valid_grp │ valid │

│ [23:0] │ [5:0] │ [1] │ [0] │

└──────────┴───────┴──────────┴───────┘

优点:整个条目只有 4 字节,一次内存读取即可获取所有信息,对 CPU cache 非常友好。

Add Rules(添加规则)

添加一条规则 (ip, depth, next_hop) 分为两个阶段:

阶段一:更新 rules_tbl(控制面)

阶段二:更新 tbl24/tbl8(数据面)

阶段一:rule_add

// rte_lpm.c

static int32_t

rule_add(struct __rte_lpm *i_lpm, uint32_t ip_masked, uint8_t depth,

uint32_t next_hop)

rules_tbl 按 depth 分组,各组在数组中紧密排列。添加新规则时,需要将更高 depth 的规则整体后移一位,为新规则腾出空间:

添加前(depth=20 的规则组后面紧跟 depth=25 的规则组):

┌────────────────┬────────────────┬────────────────┐

│ depth=20 组 │ depth=25 组 │ (空闲) │

└────────────────┴────────────────┴────────────────┘

添加 depth=20 的新规则后:

┌─────────────────┬────────────────┬────────────────┐

│ depth=20 组+1 │ depth=25 组 │ (空闲) │

└─────────────────┴────────────────┴────────────────┘

(depth=25 组的 first_rule 指针 +1,整体后移)

若规则已存在(相同 ip_masked + depth),且nexthop相同,返回 -EEXIST,不需要更新数据面。

如果next_hop 不相同, 则更新 next_hop,需要更新数据面。

阶段二:更新数据面

根据 depth 的大小,走不同的路径:

// rte_lpm.c: rte_lpm_add

if (depth <= MAX_DEPTH_TBL24) { // depth ∈ [1, 24]

status = add_depth_small(...);

} else { // depth ∈ [25, 32]

status = add_depth_big(...);

}

add_depth_small(depth ≤ 24)

核心是前缀展开(Prefix Expansion):

一条 depth=20 的规则,意味着有 2^(24-20) = 16 个 tbl24 索引都能匹配到它,因此需要将这 16 个 tbl24 条目全部填写。

// rte_lpm.c: add_depth_small

tbl24_index = ip >> 8;

tbl24_range = depth_to_range(depth); // = 1 << (24 - depth)

for (i = tbl24_index; i < (tbl24_index + tbl24_range); i++) {

// 只覆盖无效条目,或 depth 更浅(优先级更低)的条目

if (!tbl24[i].valid || (tbl24[i].valid_group == 0 &&

tbl24[i].depth <= depth)) {

// 直接写入 next_hop,valid_group = 0

__atomic_store(&tbl24[i], &new_tbl24_entry, __ATOMIC_RELEASE);

}

// 若该 tbl24 条目已经扩展到 tbl8,则同步更新 tbl8 中 depth 更浅的条目

if (tbl24[i].valid_group == 1) {

// 遍历整个 tbl8 group,更新 depth <= 当前 depth 的条目

for (j = tbl8_index; j < tbl8_group_end; j++) {

if (!tbl8[j].valid || tbl8[j].depth <= depth)

__atomic_store(&tbl8[j], &new_tbl8_entry, __ATOMIC_RELAXED);

}

}

}

示例:添加规则 10.0.0.0/20(depth=20)

IP 高 24 位范围:0x0A0000 ~ 0x0A000F(共 16 个)

tbl24:

index: 0x0A0000 0x0A0001 ... 0x0A000F

[nh=X,d=20] [nh=X,d=20] ... [nh=X,d=20]

valid_group=0(直接命中,无需查 tbl8)

add_depth_big(depth > 24)

depth > 24 时,tbl24 只有一个条目对应该规则(高 24 位唯一确定),需要借助 tbl8 存储低 8 位的区分信息。

分三种情况:

情况 1:tbl24 条目无效(全新)

1. 分配一个空闲的 tbl8 group: 注意,分配逻辑只看 tbl8 group 第一个的entry 的valid_group 是否为1

2. 在 tbl8 group 中,将 [ip & 0xFF, ip & 0xFF + range) 范围的条目写入 next_hop

3. 将 tbl24 条目更新为:valid=1, valid_group=1, group_idx=<tbl8 group 索引>

(先写 tbl8,再写 tbl24,保证原子性)

情况 2:tbl24 条目有效但未扩展(valid_group=0,已有 depth≤24 的规则)

1. 分配一个空闲的 tbl8 group

2. 用 tbl24 中已有的 next_hop 填满整个 tbl8 group(继承旧规则): 为什么? 因为depth<= 24 的entry 很显然可以匹配上当前 tbl8 中的所有项目。

3. 再将 [ip & 0xFF, ip & 0xFF + range) 范围的条目覆盖为新 next_hop: 因为这个 range 的数据都可以匹配上这个ip,并且原先的 depth <= 24 的数据优先级没有这个entry 高

4. 将 tbl24 条目更新为指向新 tbl8 group =》 nexthop 指向 tbl8_group_index, valid group 为 1

情况 3:tbl24 条目已扩展(valid_group=1,已有 tbl8)

1. 直接找到对应的 tbl8 group =》 通过 tbl24 的 nexthop

2. 在 tbl8 group 中,将 [ip & 0xFF, ip & 0xFF + range) 范围内

depth 更浅的条目覆盖为新 next_hop

flowchart TD

A["rte_lpm_add(ip, depth, next_hop)"] --> B["rule_add: 更新 rules_tbl"]

B --> C{"depth ≤ 24?"}

C -->|是| D["add_depth_small<br/>前缀展开,填写 tbl24 范围条目<br/>range = 2^(24-depth)"]

C -->|否| E{"tbl24[ip>>8] valid以及valid group状态"}

E -->|"无效 (valid=0)"| F["分配 tbl8 group<br/>写入 tbl8 条目<br/>更新 tbl24 指向 tbl8"]

E -->|"有效且未扩展<br/>(valid_group=0)"| G["分配 tbl8 group<br/>用旧 next_hop 填满 tbl8<br/>覆盖新规则范围<br/>更新 tbl24 指向 tbl8"]

E -->|"有效且已扩展<br/>(valid_group=1)"| H["直接在已有 tbl8 group<br/>中覆盖对应范围条目"]

D --> I["完成"]

F --> I

G --> I

H --> I

关键设计:写 tbl8 和写 tbl24 的顺序很重要。代码中先用

__ATOMIC_RELAXED写 tbl8,再用__ATOMIC_RELEASE写 tbl24,确保读者看到 tbl24 的新值时,tbl8 的数据已经就绪,避免读到脏数据。

Del Rules(删除规则)

删除比添加复杂,因为删除一条规则后,原来被它覆盖的“更短前缀规则“需要被恢复出来。

整体流程

// rte_lpm.c: rte_lpm_delete

int rte_lpm_delete(struct rte_lpm *lpm, uint32_t ip, uint8_t depth)

flowchart TD

A["rte_lpm_delete(ip, depth)"] --> B["rule_find: 在 rules_tbl 中找到目标规则"]

B --> C{找到?}

C -->|否| Z["返回 -EINVAL"]

C -->|是| D["rule_delete: 从 rules_tbl 中删除"]

D --> E["find_previous_rule:<br/>在 rules_tbl 中找最长的替代规则<br/>(depth 更小、前缀匹配的规则)"]

E --> F{depth ≤ 24?}

F -->|是| G["delete_depth_small"]

F -->|否| H["delete_depth_big"]

G --> I["完成"]

H --> I

find_previous_rule —— 寻找替代规则

// rte_lpm.c

static int32_t

find_previous_rule(struct __rte_lpm *i_lpm, uint32_t ip, uint8_t depth,

uint8_t *sub_rule_depth)

{

// 从 depth-1 向下逐一查找,找到第一个匹配的规则

for (prev_depth = depth - 1; prev_depth > 0; prev_depth--) {

ip_masked = ip & depth_to_mask(prev_depth);

rule_index = rule_find(i_lpm, ip_masked, prev_depth);

if (rule_index >= 0) {

*sub_rule_depth = prev_depth;

return rule_index;

}

}

return -1; // 没有替代规则

}

例如:删除 10.0.0.0/24,若存在 10.0.0.0/16,则后者就是替代规则,删除后 tbl24 中对应条目应恢复为 /16 的 next_hop。

delete_depth_small(depth ≤ 24)

遍历 tbl24 中该规则覆盖的所有条目(range = 2^(24-depth) 个):

- 无替代规则:将 depth ≤ 被删规则 depth 的条目置为无效(

valid = 0) - 有替代规则:将 depth ≤ 被删规则 depth 的条目更新为替代规则的 next_hop 和 depth

对于已扩展到 tbl8 的条目,同样需要遍历整个 tbl8 group 做相同处理。

delete_depth_big(depth > 24)

只涉及一个 tbl24 条目和对应的 tbl8 group:

- 在 tbl8 group 中,将 depth ≤ 被删规则 depth 的条目置无效或更新为替代规则

- 检查 tbl8 group 是否可以回收(

tbl8_recycle_check):

// tbl8 回收判断逻辑(tbl8_recycle_check):

// 返回 -EINVAL:整个 group 全部无效 → 可以直接释放,tbl24 条目也置无效

// 返回 >= 0 :整个 group 的值完全相同且 depth ≤ 24 → 可以"折叠"回 tbl24

// 返回 -EEXIST:group 中还有不同的有效条目 → 不能回收

flowchart TD

A["tbl8_recycle_check"] --> B{第一个条目是否有效?}

B -->|无效| C["检查其余条目是否全部无效"]

C -->|全部无效| D["返回 -EINVAL<br/>(group 为空,可释放)"]

C -->|有有效条目| E["返回 -EEXIST<br/>(不能回收)"]

B -->|有效| F{depth ≤ 24?}

F -->|否| E

F -->|是| G["检查所有条目 depth 是否相同"]

G -->|相同| H["返回 group_start<br/>(可折叠回 tbl24)"]

G -->|不同| E

tbl8 回收的两种结果:

- 全空:先将 tbl24 条目的

valid置 0,再通过tbl8_free释放 tbl8 group - 可折叠:将 tbl8 group 中的值“提升“回 tbl24(

valid_group从 1 改为 0),再释放 tbl8 group

RCU 安全:

tbl8_free在有 RCU 时不会立即清零 tbl8,而是等待所有读者离开临界区(SYNC 模式)或将其加入延迟队列(DQ 模式),避免读者访问到已被清零的 tbl8 group。

Lookup Rules(查找规则)

查找是数据面热路径,实现为内联函数,极度优化:

// rte_lpm.h

static inline int

rte_lpm_lookup(struct rte_lpm *lpm, uint32_t ip, uint32_t *next_hop)

{

unsigned tbl24_index = (ip >> 8); // 取高 24 位作为 tbl24 索引

uint32_t tbl_entry;

const uint32_t *ptbl;

// 第一次内存访问:读 tbl24

ptbl = (const uint32_t *)(&lpm->tbl24[tbl24_index]);

tbl_entry = *ptbl;

// 判断是否需要查 tbl8(valid=1 且 valid_group=1)

if (unlikely((tbl_entry & RTE_LPM_VALID_EXT_ENTRY_BITMASK) ==

RTE_LPM_VALID_EXT_ENTRY_BITMASK)) {

// 第二次内存访问:读 tbl8

unsigned tbl8_index = (uint8_t)ip + // 低 8 位

((tbl_entry & 0x00FFFFFF) * // group_idx

RTE_LPM_TBL8_GROUP_NUM_ENTRIES); // × 256

ptbl = (const uint32_t *)&lpm->tbl8[tbl8_index];

tbl_entry = *ptbl;

}

*next_hop = (tbl_entry & 0x00FFFFFF); // 取低 24 位为 next_hop

return (tbl_entry & RTE_LPM_LOOKUP_SUCCESS) ? 0 : -ENOENT;

}

查找流程:

flowchart TD

A["输入:32-bit IP 地址"] --> B["tbl24_index = ip >> 8<br/>(取高 24 位)"]

B --> C["读取 tbl24[tbl24_index]<br/>第 1 次内存访问"]

C --> D{valid=1 且<br/>valid_group=1?}

D -->|否| E{valid=1?}

E -->|否| F["未命中,返回 -ENOENT"]

E -->|是| G["命中,返回 next_hop<br/>(tbl_entry 低 24 位)"]

D -->|是| H["tbl8_index = (ip & 0xFF)<br/>+ group_idx × 256"]

H --> I["读取 tbl8[tbl8_index]<br/>第 2 次内存访问"]

I --> J{valid=1?}

J -->|否| F

J -->|是| G

性能关键点

| 特性 | 说明 |

|---|---|

| 1~2 次内存访问 | 绝大多数路由(depth ≤ 24)只需 1 次 tbl24 访问 |

| 无锁读 | 查找路径完全无锁,依赖数据流依赖保证顺序,无需内存屏障 |

| SIMD 批量查找 | rte_lpm_lookupx4 利用 SSE/NEON 一次查找 4 个 IP |

| Cache 友好 | tbl24 条目 4 字节,64 字节 cache line 可容纳 16 个条目 |

批量查找(rte_lpm_lookup_bulk)

// 两阶段批量查找,充分利用内存级并行(MLP)

// 阶段 1:批量计算所有 tbl24 索引

for (i = 0; i < n; i++)

tbl24_indexes[i] = ips[i] >> 8;

// 阶段 2:批量读取 tbl24,按需读取 tbl8

for (i = 0; i < n; i++) {

next_hops[i] = tbl24[tbl24_indexes[i]];

if (需要查 tbl8)

next_hops[i] = tbl8[...];

}

两阶段设计让 CPU 可以预取后续的 tbl24 条目,隐藏内存延迟,在大批量查找时性能显著优于逐条查找。

优势

- 对于 24bit 以下的掩码,查找复杂度基本可以认为是o(1)的.

- 用了一个大数组,内存访问会比较友好

- rcu锁,读完全无锁 (普通的rwlock对cache很不友好,有很多文章都说了rwlock在一些场景下性能甚至不如mutex!)

- 这个设计很符合硬件的设计逻辑,适合硬件卸载

劣势

- 占用内存大,单个LPM表初始化之后占用就在 60M+

- KEY 无法扩展,只支持了 IPV4/IPV6,ipv6的字节足够长,可能通过构造也勉强能用

- nexthop 无法扩展,现在给的是portId, 实际使用的时候往往有更多的需求

- lpm add/del 最差情况下是o(n)的,主要开销是在 rule 的管理: 实际使用中还好,因为很多sdn网络也不会有那么快的路由变配。

mlx5驱动

mlx5驱动是给 mellanox CX6 网卡使用的。

它既有内核态的驱动,也有用户态符合 ibverbs 生态的用户态 驱动 。 可能 ibverbs 相关的内容也不能叫驱动。不过确实提供了访问网卡的路径。

此外,对于 DPDK ,它在使用 cx6 网卡时,使用ibverbs库作为访问网卡的途径。 所以在研究完前置条件之后,再把 DPDK 的使用方法再看一看。

OFED

firmware, driver 等,有一套专门的框架来管理,叫 OFED。

对于内核驱动,可以使用 kernel upstream 的驱动,但是这个更新的可能不如 OFED 那么快。厂商一般也是通过OFED来发行他们的网卡驱动,所以就从OFED入手。

使用的OFED为 MLNX_OFED_LINUX-5.14.0-2.0.1.myos.x86_64.tgz

linux Kernel Driver:

rdma-core

DPDK

debug_iptables

有些cni 如calico等还在使用iptables作为规则下发工具。

有的时候会出现丢包,这个时候就要去查看iptables,但这个工具列出的规则很抽象。

下面总结了常见的规则查看方法 和 debug 手段。

IP tables 四表5链

flowchart TD

A[PREROUTING <br/> raw->mangle->nat] --> B{Destination为本机}

B -->|是| C[Input <br/> mangle->filter]

C --> F[application]

B -->|否| D[FORWARD <br/> mangle->filter]

D --> E[POSTROUTING <br/> mangle->nat]

F --> G[OUTPUT <br/> raw->mangle->nat->filter]

G --> E

H[NIC] --> A

E --> H

注意,这只是一种典型实现。有的实现的链里面可能会有额外的表,比如说有点 input 链可能会有 nat表。具体情况具体分析。

比如通 iptable -L -n -t raw 就可以看出raw表所有的链。

- nat表: 会把一些nat规则放进来,通常在 prerouting, postrouting 的时候生效。也就是说路由之前把ip nat一下,让一个外部ip变成内部ip,然后在出网络的时候,再nat一下,让内部的ip变成外部的ip。

- raw表: 这个表一般没啥数据,通常在 PREROUTING 和 OUTPUT 链存在,可以用来做流量统计,TRACE 之类的。

- mangle表: 修改表,可以用来修改checksum之类的

- filter表: 过滤表,通常防火墙的实现在这里。这里就可以看到哪些流量会被reject/Drop掉等等。在 INPUT 和 FORWARD 以及 OUTPUT 三个点。

IP rules 解析

结合着例子来看

[root@localhost ~]# iptables -t filter -L -n

Chain INPUT (policy ACCEPT)

target prot opt source destination

LIBVIRT_INP all -- 0.0.0.0/0 0.0.0.0/0

...

# 这里就是说,在 input 上,所有流量(前缀匹配)都到目标链 LIBVIRT_INP

# 使用下面的命令查看链上的数据,默认动作是pass

[root@localhost ~]# iptables -t filter -L LIBVIRT_INP -n

Chain LIBVIRT_INP (1 references)

target prot opt source destination

ACCEPT udp -- 0.0.0.0/0 0.0.0.0/0 udp dpt:53

ACCEPT tcp -- 0.0.0.0/0 0.0.0.0/0 tcp dpt:53

ACCEPT udp -- 0.0.0.0/0 0.0.0.0/0 udp dpt:67

ACCEPT tcp -- 0.0.0.0/0 0.0.0.0/0 tcp dpt:67

再有一个例子,比如说在虚拟机场景, 虚拟机创建的vm的nic绑定到nc的br0(192.168.1.1/24)口上。

可以按照这个操作来绑定

ip l add name br0 type bridge

virsh attach-interface demovm2 --type bridge --source br0 --model virtio #添加一块网卡,指定模式virtio网卡更快

ip a add 192.168.1.1/24 dev br0

也就是说 br0 作为虚拟网桥,连接vm 和 物理机。

假设现在通过qemu创建了一个vm,192.168.1.2/24, 一个场景是vm需要访问外部物理机器。

可以用 NAT 模式来实现这个功能(如果用过vmware,就知道了为什么它有个网卡模式叫nat模式)。

# vm发送到外界,比如说dns query 8.8.8.8,流量会从br0 口上收到, 进入 PREROUTING 链

# 但是这个ip不在物理机上,如果不开ip_forward,会直接被丢弃掉,所以首先将 net.ipv4.ip_forward 打开

sysctl -w net.ipv4.ip_forward=1

# 接下来,流量会依次经过 FOWARD 链,POSTROUTING 链